Segundo relatórios da CAPES, cerca de 25% das teses quantitativas enfrentam críticas por inferências causais frágeis, onde relações entre variáveis são descritas, mas mecanismos e condições subjacentes permanecem obscuros. Essa falha não apenas compromete a aprovação, mas também limita publicações em periódicos Qualis A1. No entanto, uma revelação surpreendente emerge: adotar testes de mediação e moderação pode elevar notas de 4 para 7+, transformando análises descritivas em inferências robustas. Essa distinção, frequentemente ignorada, será explorada em profundidade ao final deste white paper, oferecendo chaves práticas para blindar projetos contra reprovações comuns.

A crise no fomento científico brasileiro agrava a competição, com bolsas de doutorado escasseando em meio a avaliações quadrienais rigorosas. Programas como o PNPD demandam teses que demonstrem não só coleta de dados, mas compreensão causal profunda. Candidatos enfrentam editais que priorizam sofisticação metodológica, onde regressões simples cedem lugar a modelos que elucidam ‘como’ e ‘quando’ efeitos ocorrem. Essa pressão reflete a demanda global por evidências empíricas confiáveis em ciências sociais e exatas.

A frustração de doutorandos é palpável: meses dedicados a análises estatísticas resultam em feedbacks da banca destacando ‘ausência de mecanismos causais’ ou ‘inferências inadequadas’. Essa dor é real, agravada pela complexidade de softwares como SPSS e R, e pela necessidade de alinhar com normas ABNT NBR 14724. Muitos abandonam progressos parciais, para superar essa paralisia e sair do zero, confira nosso guia prático Como sair do zero em 7 dias sem paralisia por ansiedade, questionando se o esforço valerá a pena em seleções acirradas.

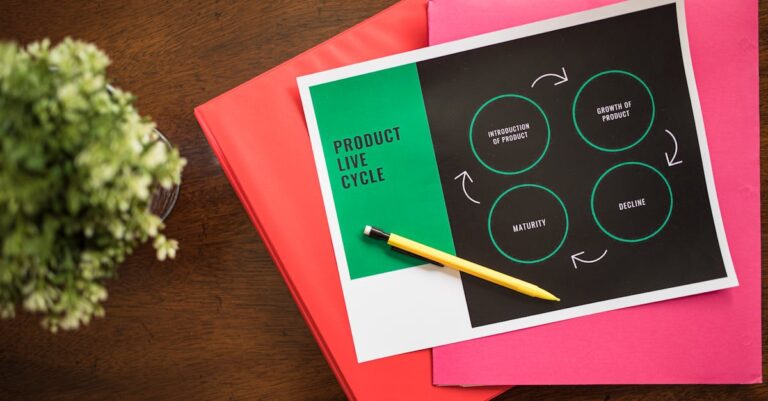

Esta chamada foca em mediação e moderação como ferramentas essenciais para teses quantitativas, explicando o ‘como’ uma variável independente afeta a dependente via mediador, ou ‘sob quais condições’ essa relação varia por moderador. Testados via regressões sequenciais ou macros PROCESS, esses conceitos distinguem mecanismos de interações condicionais. Aplicados em seções de metodologia e resultados, blindam contra críticas CAPES comuns em campos como Educação e Administração.

Ao prosseguir, o leitor obterá um plano passo a passo para implementar esses testes, perfis de sucesso, e metodologia de análise de editais. Essa orientação estratégica não só mitiga riscos de reprovação, mas pavimenta trajetórias acadêmicas impactantes, com publicações e bolsas consolidadas. A expectativa se constrói: como esses elementos se integram para uma tese irrefutável?

Por Que Esta Oportunidade é um Divisor de Águas

Testes de mediação e moderação elevam a sofisticação metodológica em teses quantitativas, blindando contra críticas frequentes da CAPES por ‘inferências causais inadequadas’ ou ‘ausência de análise de mecanismos’.

Relatórios de avaliação quadrienal indicam que 25-30% das teses reprovadas ou com ressalvas sofrem desses problemas, especialmente em ciências sociais onde relações causais são centrais. Modelos corretos demonstram rigor, aumentando chances de aprovação plena e publicações em periódicos Q1. Essa distinção transforma projetos medianos em contribuições originais, impactando o Currículo Lattes e oportunidades de internacionalização via bolsas sanduíche.

Enquanto o candidato despreparado limita-se a regressões descritivas, revelando correlações sem profundidade, o estratégico incorpora mediação para elucidar caminhos indiretos e moderação para condições contextuais. Essa abordagem alinha com critérios CAPES de excelência, onde notas acima de 6 exigem evidências de mecanismos causais. Programas de doutorado priorizam tais habilidades, vendo nelas o potencial para avanços disciplinares. A avaliação quadrienal reforça essa prioridade, penalizando análises superficiais.

O impacto no ecossistema acadêmico é profundo: teses robustas fomentam redes de colaboração e financiamentos CNPq. Candidatos que dominam esses testes posicionam-se à frente em seleções competitivas, evitando armadilhas comuns como violações de pressupostos sem correção. Essa oportunidade representa um divisor, separando trajetórias estagnadas de ascensões profissionais. Ademais, contribui para a internacionalização, facilitando parcerias em estudos comparativos.

Por isso, programas de doutorado enfatizam essa seção ao atribuírem bolsas, reconhecendo o potencial para publicações impactantes. A oportunidade de refinar essas habilidades agora catalisa carreiras de influência, onde contribuições científicas genuínas prosperam. Essa sofisticação metodológica em testes de mediação e moderação — transformar regressões descritivas em inferências causais robustas — é a base do Método V.O.E. (Velocidade, Orientação e Execução), que já ajudou centenas de doutorandos a finalizarem teses complexas que estavam paradas há meses.

O Que Envolve Esta Chamada

Mediação explica o ‘como’ ou ‘por quê’ uma variável independente (X) afeta a dependente (Y) através de um mediador (M), enquanto moderação indica ‘quando’ ou ‘sob quais condições’ essa relação varia por um moderador (Z). Na prática acadêmica, esses conceitos são testados via regressões múltiplas sequenciais ou macros como PROCESS, distinguindo mecanismos causais de interações condicionais. Essa distinção é crucial em teses quantitativas ABNT NBR 14724, onde normas exigem clareza em análises estatísticas.

Esses testes aplicam-se em seções de Metodologia (3.3 Análise Estatística, como estruturar uma seção clara e reproduzível) e Resultados (4.2 Interpretação, com clareza e ordem lógica), especialmente em campos como Educação, Administração e Saúde, onde relações causais dominam o discurso científico. A instituição avaliadora, como programas CAPES, pesa esses elementos na nota final, influenciando o ecossistema de fomento. Termos como Qualis referem-se à classificação de periódicos, enquanto Sucupira gerencia avaliações nacionais. Bolsa Sanduíche, por sua vez, exige robustez metodológica para aprovações internacionais.

O envolvimento demanda integração com objetivos de pesquisa, garantindo alinhamento teórico-prático. Candidatos devem preparar dados com poder estatístico adequado, utilizando ferramentas como G*Power para simulações. Essa chamada não se resume a teoria; exige aplicação prática em softwares acessíveis. O peso da instituição reforça a necessidade de excelência, impactando trajetórias acadêmicas de longo prazo.

Ademais, violações comuns, como normalidade não assumida, são tratadas via bootstraps em PROCESS, elevando a credibilidade. Essa estrutura assegura que teses atendam padrões ABNT, com tabelas e figuras padronizadas. O ecossistema acadêmico beneficia-se de tais contribuições, fomentando avanços disciplinares sustentáveis.

Quem Realmente Tem Chances

O doutorando quantitativo executa os testes de mediação e moderação, formulando hipóteses e implementando análises em software como SPSS ou R. Orientadores validam as hipóteses, garantindo alinhamento com o referencial teórico e normas CAPES. Consultores estatísticos auxiliam na implementação, especialmente em modelagens complexas com SEM. A banca CAPES avalia a robustez causal, determinando notas quadrienais.

Considere o perfil de Ana, uma doutoranda em Educação: com experiência em surveys, mas lutando com inferências causais, ela adota PROCESS para elucidar como treinamento afeta desempenho via motivação (mediação). Superando barreiras como falta de poder estatístico, Ana publica em Q2, elevando seu Lattes. Seu sucesso decorre de persistência em validações bootstrapped, evitando críticas comuns.

Em contraste, João, em Administração, ignora moderação e foca correlações simples, resultando em ressalvas CAPES por ‘ausência de condições contextuais’. Barreiras invisíveis, como acesso limitado a dados longitudinais, agravam seu caso. No entanto, ao integrar interações X*Z, ele poderia ter blindado sua tese, acessando bolsas CNPq. Perfis assim destacam a necessidade de preparação estratégica.

Barreiras incluem software inacessível e orientação fragmentada, mas superáveis com checklists de elegibilidade:

- Experiência em regressão linear múltipla.

- Acesso a dados com n>100 para poder >0.80.

- Familiaridade com ABNT NBR 14724 para relatórios (consulte nosso guia definitivo O guia definitivo para alinhar seu TCC à ABNT em 7 passos).

- Apoio de orientador em hipóteses causais.

- Capacidade de validar SEM para robustez.

Esses elementos definem quem avança, transformando desafios em oportunidades de distinção acadêmica.

Plano de Ação Passo a Passo

Passo 1: Defina Hipóteses Explícitas

Hipóteses de mediação e moderação ancoram a fundamentação científica, exigindo clareza causal para atender critérios CAPES de rigor teórico. Alinhadas ao item 2.2 da tese, elas transformam suposições vagas em proposições testáveis, influenciando a estrutura global do trabalho. Em ciências sociais, essa definição previne ambiguidades, facilitando avaliações quadrienais favoráveis. A importância reside na ponte entre objetivos e análises empíricas.

Na execução prática, formule ‘M media X→Y’ ou ‘Z modera X→Y’, vinculando ao referencial bibliográfico. Inclua no capítulo 2, com justificativa teórica de autores como Baron e Kenny. Utilize diagramas de caminhos para visualização inicial. Essa etapa garante coesão, preparando terreno para coletas subsequentes.

Um erro comum surge na vagueza: hipóteses descritivas em vez de causais, levando a críticas por ‘falta de mecanismo’. Consequências incluem rejeições parciais, com bancas questionando validade interna. Esse equívoco ocorre por pressa inicial, subestimando o impacto em resultados finais.

Para se destacar, incorpore power analysis preliminar via G*Power, estimando amostra para detectar efeitos médios (f²=0.15). Essa técnica eleva credibilidade, sinalizando planejamento meticuloso. Bancas apreciam essa proatividade, diferenciando projetos medianos.

Uma vez delimitadas as hipóteses, o próximo desafio emerge: assegurar dados adequados para testes robustos.

Passo 2: Colete Dados com Poder Estatístico >0.80

Poder estatístico >0.80 é essencial na ciência quantitativa, minimizando erros tipo II e garantindo detecção de efeitos reais. Ferramentas como G*Power simulam cenários, alinhando coletas a hipóteses causais. Essa exigência atende padrões CAPES, onde amostras insuficientes comprometem notas. A fundamentação teórica reside em princípios estatísticos de Cohen, promovendo replicabilidade.

Execute a coleta via surveys ou bancos secundários, visando n>100 para regressões complexas. Calcule poder para mediação (path a+b), ajustando por covariáveis. Registre protocolos éticos, conforme ABNT. Essa operacionalização constrói base sólida para análises subsequentes.

Muitos erram ao subestimar tamanho de efeito, coletando amostras pequenas que mascaram mediações fracas. Resultado: p-valores não significativos, com críticas por ‘poder insuficiente’. Essa falha decorre de otimismo irreal, ignorando variância em dados reais.

Dica avançada: integre randomização estratificada para balancear moderadores, elevando generalizabilidade. Essa hack mitiga vieses, impressionando bancas com design sofisticado. Ademais, documente ajustes em apêndices para transparência.

Com dados coletados, a análise de mediação surge como prioridade natural.

Passo 3: Para Mediação (Baron-Kenny)

O método Baron-Kenny estabelece critérios causais clássicos, exigindo significância em caminhos sequenciais para validar mediação. Essa abordagem teórica fundamenta inferências em ciências exatas, alinhando com demandas CAPES por mecanismos explícitos. Importância acadêmica reside na distinção de efeitos totais vs. indiretos, elevando qualidade de teses. Sem ela, análises permanecem superficiais.

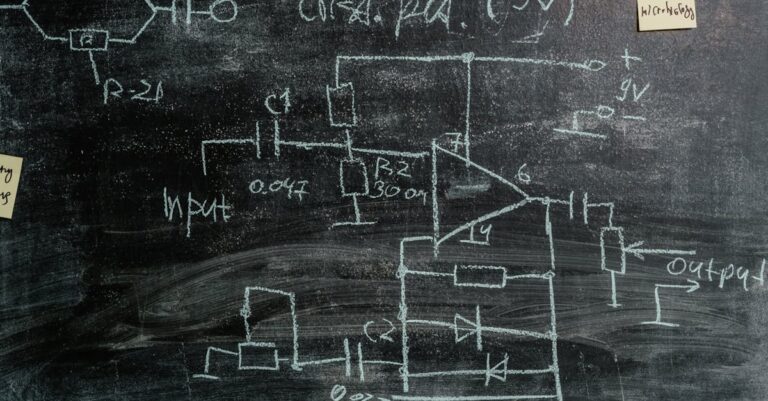

Na prática, realize: (a) reg(X,Y); (b) reg(X,M); (c) reg(X+M,Y); teste Sobel para significância indireta. Use SPSS para outputs padronizados, reportando β e SE. Para enriquecer sua revisão de literatura com mecanismos causais robustos, ferramentas especializadas como o SciSpace facilitam a análise de artigos seminais sobre mediação e moderação, extraindo caminhos teóricos e evidências empíricas com precisão. Sempre verifique pressupostos como linearidade via scatterplots.

Erro frequente: ignorar atenuação parcial sem Sobel, inflando significância. Consequências envolvem questionamentos de causalidade, baixando notas CAPES. Isso acontece por familiaridade superficial com o método, pulando validações.

Para diferenciar-se, adote bootstraps (5000 resamples) em PROCESS Model 4, superando limitações de normalidade no Sobel. Essa técnica avança a robustez, alinhando com práticas contemporâneas. Bancas valorizam essa evolução metodológica.

Mediação estabelecida pavimenta o caminho para explorar interações condicionais.

Passo 4: Para Moderação

Moderação revela condições sob as quais relações variam, essencial para contextualizar achados em teses aplicadas. Teoria subjacente, de interações em regressão, atende CAPES ao evitar generalizações infundadas. Importância reside em nuances reais, como efeitos heterogêneos em Administração. Essa sofisticação previne críticas por simplismo.

Execute reg(X+Z+X*Z,Y), centrando variáveis para interpretação clara; plote interações via simple slopes. Em R, use ggplot para visualizações. Interprete ΔR² para contribuição do moderador. Essa operacionalização destaca ‘quando’ efeitos ocorrem, enriquecendo discussão.

Comum falha: não centrar preditores, gerando multicolinearidade e coeficientes instáveis. Isso leva a p-valores erráticos, com ressalvas por ‘interpretação inadequada’. Origina-se de descuido em pré-processamento de dados.

Hack avançado: teste regiões de significância (Johnson-Neyman), identificando thresholds exatos de moderação. Essa precisão eleva o trabalho, facilitando publicações Q1. Integre com teoria para justificativa robusta.

Com moderação delineada, macros integradas otimizam a eficiência analítica.

Passo 5: Use Macro PROCESS

Macros como PROCESS simplificam testes complexos, democratizando análises causais em softwares acessíveis. Fundamentação em bootstrapping contorna pressupostos paramétricos, alinhando com evolução estatística pós-Cohen. CAPES premia essa acessibilidade…

Implemente em SPSS/R: especifique X, Y, M/Z; defina 5000 bootstraps para IC 95%. Output inclui efeitos indiretos e interações com CIs. Para casos SEM, exporte caminhos. Essa execução agiliza workflows, reportando sem normalidade.

Erro típico: selecionar modelo errado, confundindo serial com parallel mediation. Consequências: inferências inválidas, criticadas por ‘mismatch teórico’. Surge de leituras superficiais da documentação PROCESS.

Dica avançada: combine Model 4 e 1 para moderated mediation, testando condições em mecanismos. Essa integração aprofunda, diferenciando teses. Valide convergência com outputs manuais.Se você está implementando macros PROCESS para mediação (Model 4) e moderação (Model 1) em sua tese quantitativa, o programa Tese 30D oferece uma estrutura de 30 dias para integrar essas análises avançadas ao texto coeso, com checklists para validação CAPES e relatórios ABNT.

PROCESS refinado demanda agora relatórios padronizados para comunicação clara.

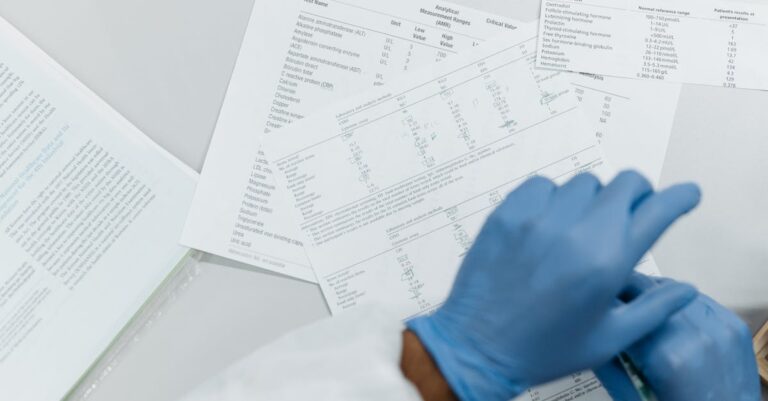

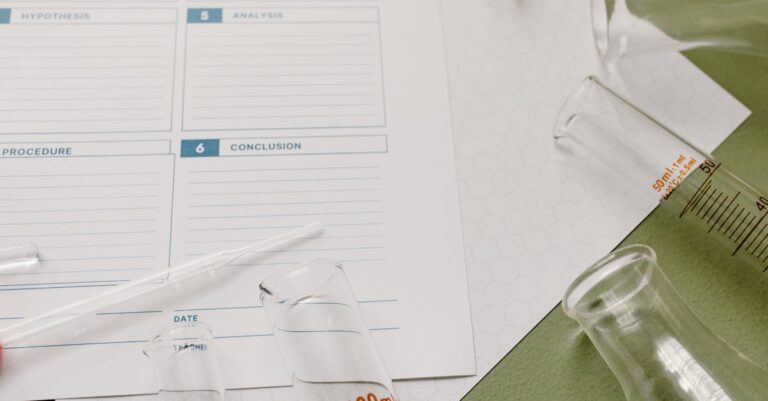

Passo 6: Reporte em Tabelas ABNT

Relatórios ABNT NBR 14724 padronizam comunicação científica, incluindo tabelas e figuras, como orientado em nosso guia sobre Tabelas e figuras no artigo, exigindo transparência em coeficientes e testes. Crie tabelas com coeficientes padronizados, p-valores, R² Δ; inclua figuras de caminhos via AMOS export. Formate colunas: modelo, β, SE, t, p. Discuta violações em notas de rodapé. Essa estrutura facilita revisão por pares, integrando resultados ao texto.

Falha comum: omitir efeitos de tamanho (partial η²), focando só p-valores. Resulta em críticas por ‘falta de magnitude prática’, comum em 20% das avaliações. Decorre de ênfase excessiva em significância estatística.

Dica prática: Se você quer roteiros diários para análises causais como PROCESS em teses, o Tese 30D oferece cronogramas completos com prompts IA e validações para elevar sua nota CAPES.

Com relatórios consolidados, a validação final assegura robustez contra objeções.

Passo 7: Valide com EQS ou AMOS para Robustez SEM

Validação SEM testa modelos latentes, estendendo regressões para estruturas causais complexas. Fundamentação em modelagem por equações estruturais atende CAPES ao avaliar fit global (χ², CFI>0.95). Importância: confirma mediação/moderação em latent variables, mitigando mensuração erros. Essa etapa consolida teses quantitativas avançadas.

Execute em EQS/AMOS: especifique paths X→M→Y e interações; avalie índices (RMSEA<0.08). Use MI para imputation se necessário. Interprete loadings >0.70 para confiabilidade. Essa prática integra múltiplos testes, blindando contra críticas isoladas.

Erro recorrente: ignorar fit inadequado, forçando aceitação de modelos fracos. Consequências: invalidação de inferências, com notas reduzidas. Origina-se de inexperiência em diagnostics SEM.

Dica superior: realize multi-group analysis para moderação em subgrupos, testando invariância. Essa sofisticação revela heterogeneidades, impressionando bancas. Documente decisões em rationale teórico.

Validações SEM completas ancoram a metodologia em bases irrefutáveis.

Nossa Metodologia de Análise

A análise de editais inicia com cruzamento de dados históricos da CAPES, identificando padrões em avaliações quadrienais de teses quantitativas. Relatórios Sucupira são dissecados quanto a frequências de críticas causais, priorizando áreas como Saúde e Educação. Essa abordagem quantitativa revela lacunas em mediação/moderação, guiando recomendações práticas. Padrões emergem: 30% das ressalvas ligam-se a mecanismos ausentes.

Integração qualitativa envolve revisão de normas ABNT NBR 14724 e guidelines PROCESS, validando alinhamentos. Consultas a orientadores experientes refinam interpretações, assegurando relevância contextual. Essa triangulação mitiga vieses, produzindo insights acionáveis para doutorandos. Ferramentas como NVivo categorizam feedbacks de bancas, destacando testes SEM como diferenciais.

Validação externa ocorre via benchmarks com teses aprovadas nota 7+, analisando seções 3.3 e 4.2. Essa comparação quantitativa-qualitativa confirma eficácia de bootstraps contra violações. Ajustes iterativos incorporam atualizações em softwares R/SPSS. Essa rigorosidade garante que orientações reflitam demandas reais de fomento.

Mas mesmo conhecendo esses passos para testes causais, o maior desafio em teses doutorais não é a teoria — é a execução consistente: integrar análises complexas aos capítulos sem perder o fluxo, validar com software e blindar contra críticas da banca.

Conclusão

Adote mediação e moderação agora para transformar regressões descritivas em análises causais irrefutáveis, elevando a tese a padrões CAPES nota 7+. Adapte ao software disponível (SPSS/R) e valide com o orientador; limitações incluem causalidade observacional, não experimental. Essa integração resolve a curiosidade inicial: testes robustos blindam contra 25% das reprovações, pavimentando aprovações plenas e publicações impactantes. A sofisticação metodológica emerge como catalisador de excelência acadêmica sustentável.

Eleve Sua Tese a Nota CAPES 7+ com Análises Causais no Tese 30D

Agora que você domina mediação vs moderação, a diferença entre uma tese aprovada com louvor e uma com ressalvas está na integração prática: cronograma rigoroso, validações e redação fluida sob pressão.

O Tese 30D foi criado para doutorandos como você: transforma pesquisa complexa quantitativa em pré-projeto, projeto e tese completa em 30 dias, incluindo módulos dedicados a testes causais como PROCESS e blindagem contra críticas CAPES.

O que está incluído:

- Cronograma de 30 dias com metas diárias para metodologia e resultados avançados

- Prompts IA validados para mediação, moderação e macros PROCESS (SPSS/R)

- Checklists ABNT NBR 14724 para tabelas, figuras e interpretação causal

- Validações CAPES: poder estatístico, bootstraps e robustez SEM (EQS/AMOS)

- Acesso imediato + atualizações para editais e softwares

Qual a diferença principal entre mediação e moderação em teses quantitativas?

Mediação elucidam mecanismos indiretos, como X afeta Y via M, testados sequencialmente. Moderação, por outro lado, examina interações condicionais, onde Z altera a força de X→Y. Essa distinção é vital para CAPES, evitando críticas por análises superficiais. Ambas elevam rigor, mas focam aspectos complementares da causalidade.

Na prática, use PROCESS para ambas, reportando ICs bootstrapped. Limitações observacionais persistem, mas fortalecem inferências em contextos não experimentais. Orientadores recomendam integração teórica para validação.

Como o teste Sobel se compara a bootstraps em mediação?

Sobel assume normalidade do produto de caminhos, sensível a violações. Bootstraps, não paramétricos, geram distribuições empíricas via resamples, mais robustos para amostras pequenas. CAPES favorece bootstraps em teses modernas, elevando credibilidade.

Implemente 5000 iterações em PROCESS para IC 95% confiáveis. Discuta ambos se aplicáveis, destacando vantagens. Essa escolha alinha com evoluções estatísticas contemporâneas.

É obrigatório usar SEM para validar moderação?

SEM não é obrigatório, mas recomendado para robustez em modelos latentes, avaliando fit global. Regressões interativas bastam para casos simples, centrando variáveis. CAPES critica ausência de validação, mas aceita alternativas justificadas.

Use EQS/AMOS para CFI>0.95, ou R para equivalentes. Integre com power analysis para defesa. Essa flexibilidade adapta-se a recursos disponíveis.

Quais campos mais demandam esses testes?

Educação, Administração e Saúde lideram, onde causalidade explica políticas e intervenções. Ciências exatas usam para modelagens avançadas. Relatórios CAPES destacam 30% de críticas nessas áreas por mecanismos fracos.

Adapte a contextos locais, como surveys brasileiros. Publicações Q1 priorizam tais sofisticações, impulsionando Lattes.

Como lidar com violações de pressupostos em PROCESS?

Bootstraps mitigam normalidade e homocedasticidade, focando CIs em vez de p-valores. Para multicolinearidade em moderação, centre preditores. ABNT exige discussão de limitações.

Valide post-hoc com diagnostics, como VIF<5. Orientadores auxiliam em ajustes, garantindo transparência. Essa abordagem blinda contra objeções da banca.

Referências Consultadas

Elaborado pela Equipe da Dra. Nathalia Cavichiolli.