Segundo relatórios da CAPES, cerca de 70% das reprovações em teses de doutorado nas áreas de Ciências Humanas e Sociais decorrem de falhas metodológicas, particularmente em abordagens qualitativas que carecem de rigor teórico. Doutorandos frequentemente subestimam a complexidade da Grounded Theory (GT), resultando em críticas por subjetividade excessiva ou falta de transparência no processo de construção de teoria, e aprender a lidar com essas críticas de forma construtiva pode transformar sua defesa. Essa realidade revela uma armadilha comum: muitos candidatos adotam GT como rótulo fashionável, sem compreender suas demandas iterativas, o que compromete não apenas a aprovação, mas também a publicabilidade em periódicos Qualis A1. No entanto, o que diferencia projetos aprovados de forma unânime? A chave reside em evitar erros sistemáticos que transformam uma metodologia poderosa em fonte de vulnerabilidade perante a banca avaliadora.

O fomento ao doutorado no Brasil enfrenta uma crise de competitividade, com editais da CAPES e agências como CNPq priorizando propostas que demonstrem inovação metodológica e replicabilidade. Nas áreas 5 a 7 da avaliação quadrienal, teses qualitativas representam 40% dos submissões, mas apenas 25% recebem conceito máximo devido a inconsistências na seção de Métodos. Essa pressão reflete a demanda global por ciências sociais mais robustas, onde o constructivismo de Charmaz ganha terreno sobre abordagens positivistas tradicionais. Assim, o ambiente acadêmico brasileiro exige que doutorandos dominem ferramentas como GT para elevar o status de suas contribuições.

Frustrações abundam entre candidatos que investem anos em coleta de dados, apenas para enfrentar questionamentos sobre viés interpretativo ou saturação inadequada durante a defesa. A sensação de impotência surge quando orientadores alertam para ‘falta de rigor’, e revisores de periódicos rejeitam manuscritos por descrições superficiais. Essas dores não derivam de falta de dedicação, mas de orientações fragmentadas que ignoram a integração ABNT de processos GT. Validar essas experiências comuns reforça que o caminho para aprovação passa por correções precisas e documentadas.

Grounded Theory emerge como uma oportunidade estratégica para teses qualitativas, construindo teoria indutivamente a partir de dados brutos por meio de codificação aberta, axial e seletiva, além de memo-writing e amostragem teórica. Integrada à seção de Métodos clara e reproduzível conforme NBR 14724, essa abordagem mitiga críticas CAPES ao expor o processo iterativo de forma transparente. Para aprofundar na estruturação dessa seção em teses qualitativas, confira nosso guia prático. Nas ciências sociais e humanas, GT permite modelos explicativos emergentes de fenômenos complexos, como dinâmicas culturais ou trajetórias sociais. Adotá-la corretamente não só fortalece a tese, mas pavimenta o percurso para bolsas sanduíche e publicações internacionais.

Ao longo deste white paper, estratégias comprovadas para evitar cinco erros fatais na aplicação de GT serão exploradas, desde a imposição de teorias prévias até a integração deficiente com normas ABNT. Cada seção oferece orientação prática para elevar o rigor teórico, preparando o leitor para defesas orais convincentes e avaliações positivas. Ao final, uma revelação surpreendente sobre como pequenas ajustes na documentação podem dobrar as chances de aprovação será desvelada, inspirando ações imediatas que transformam desafios em conquistas acadêmicas duradouras.

Por Que Esta Oportunidade é um Divisor de Águas

Grounded Theory eleva o rigor metodológico em teses qualitativas, reduzindo críticas CAPES por subjetividade ao demonstrar transparência no processo de construção teórica. Essa metodologia iterativa permite que teorias emergam diretamente dos dados, contrastando com abordagens dedutivas que impõem frameworks prévios e frequentemente resultam em rejeições. Nas áreas 5-7 da CAPES, onde 70% das reprovações envolvem métodos frágeis, GT se destaca por promover amostragem teórica e codificação sistemática, melhorando as chances de aprovação em seleções competitivas. Além disso, a adoção de GT impacta positivamente o currículo Lattes, facilitando a internacionalização via colaborações com estudos semelhantes no exterior.

Comparado ao candidato despreparado, que ignora memo-writing e saturação, o estratégico documenta cada iteração, evitando acusações de viés subjetivo. Relatórios da Avaliação Quadrienal CAPES de 2017-2020 indicam que programas com ênfase em qualitativo rigoroso receberam conceitos 5 ou superior em 60% dos casos, contra 30% para métodos híbridos mal integrados. Por isso, dominar GT não se limita à tese; estende-se a publicações em Qualis A1/A2, onde a transparência processual é critério primordial. Essa distinção separa trajetórias acadêmicas estagnadas de carreiras influentes em ciências sociais.

Oportunidades como essa surgem em um contexto de escassez de guias práticos para GT no Brasil, onde a maioria dos manuais foca em quantitativo. Adotar GT corretamente constrói credibilidade perante bancas, que valorizam a capacidade de justificar saturação teórica durante defesas orais. Além da aprovação, benefícios incluem menor revisão em periódicos e maior atratividade para bolsas CNPq. Assim, investir em rigor GT representa um divisor de águas para doutorandos em humanidades.

Essa elevação do rigor metodológico em teses qualitativas — transformando teoria emergente em execução diária e transparente — é a base do Método V.O.E. (Velocidade, Orientação e Execução), que já ajudou centenas de doutorandos em ciências humanas a finalizarem teses paradas há meses e evitarem críticas CAPES.

O Que Envolve Esta Chamada

Grounded Theory (GT) constitui uma metodologia qualitativa iterativa que constrói teoria indutivamente a partir de dados coletados, com ênfase em codificação aberta, axial e seletiva, memo-writing e amostragem teórica, alinhada ao constructivismo de Kathy Charmaz. Na prática acadêmica brasileira, integra-se à seção de Métodos ABNT para gerar modelos explicativos emergentes de fenômenos sociais, como interações culturais ou políticas públicas. Essa abordagem difere de etnografias descritivas ao priorizar a emergência de conceitos a partir de padrões nos dados, promovendo explicações causais ancoradas na realidade empírica.

A instituição CAPES avalia teses sob o prisma da NBR 14724, onde a subseção de Procedimentos de Análise deve detalhar o ciclo iterativo de coleta e análise. Especialmente em projetos de ciências sociais e humanas, GT atende à demanda por rigor contra viés, com fluxogramas adaptados de PRISMA para qualitativos ilustrando o processo. O peso da CAPES no ecossistema acadêmico reside em sua influência sobre conceitos programáticos, bolsas e acreditação de cursos, tornando a maestria em GT essencial para competitividade. Termos como Qualis referem-se à classificação de periódicos, enquanto Sucupira gerencia dados avaliativos, e Bolsa Sanduíche financia estágios internacionais.

Envolve também a defesa oral, onde saturação teórica deve ser justificada com critérios explícitos, como ausência de novos códigos em entrevistas subsequentes. Essa chamada para rigor metodológico reflete tendências globais em ciências sociais, onde GT facilita publicações em journals como Qualitative Inquiry. No Brasil, programas de doutorado em áreas 5-7 priorizam tais métodos para elevar o impacto societal das teses. Assim, dominar GT transforma submissões rotineiras em contribuições avaliadas como excepcionais.

O que parece abstrato revela-se operacionalizável, com etapas claras que blindam contra críticas comuns. Instituições como USP e UNICAMP exemplificam sucesso em GT, com teses aprovadas que integram ABNT sem comprometer a iteração qualitativa. Essa integração eleva o padrão geral de pesquisa nacional, beneficiando o ecossistema inteiro.

Quem Realmente Tem Chances

Doutorandos executam codificações e memos, orientadores validam a teoria emergente, bancas CAPES avaliam o rigor contra viés, e revisores de periódicos verificam a consistência metodológica. No entanto, chances reais concentram-se em candidatos com background em qualitativo, como graduados em Antropologia ou Sociologia, que já lidam com narrativas complexas. Perfil típico: o pesquisador persistente, com mestrado em ciências humanas, que dedica tempo diário a análise iterativa, contrastando com iniciantes sobrecarregados por disciplinas quantitativas.

Imagine Ana, doutoranda em Educação, que entra no programa com experiência em entrevistas semiestruturadas, mas luta com saturação teórica devido a amostras pequenas. Ela frequenta workshops CAPES sobre ABNT, consulta Charmaz religiosamente e colabora com pares para triangulação, elevando sua tese de mediana a aprovada com louvor. Barreiras invisíveis incluem acesso limitado a software como NVivo ou isolamento geográfico, mas sua proatividade mitiga esses obstáculos. Ana representa quem tem chances: adaptável, documentada e orientada por feedback contínuo.

Agora, considere João, oriundo de Administração, que adota GT superficialmente para ‘modernizar’ sua tese quantitativa, ignorando memos e impondo hipóteses prévias. Sem validação com orientador, sua defesa enfrenta questionamentos sobre subjetividade, resultando em condicionantes. Barreiras como falta de mentoria ou pressão por resultados rápidos o sabotam, ilustrando perfis com chances reduzidas. Enquanto Ana prospera pela imersão, João exemplifica armadilhas evitáveis.

Checklist de elegibilidade:

- domínio básico de qualitativo, acesso a participantes para amostragem teórica, software de análise e alinhamento com normas ABNT.

- Verifique se sua proposta aborda fenômenos sociais emergentes, compatíveis com constructivismo.

- Confirme disponibilidade para iterações diárias, essencial contra procrastinação.

- Avalie rede de suporte, pois isolamento compromete triangulação.

- Por fim, teste compatibilidade com área CAPES, priorizando humanidades para GT otimizada.

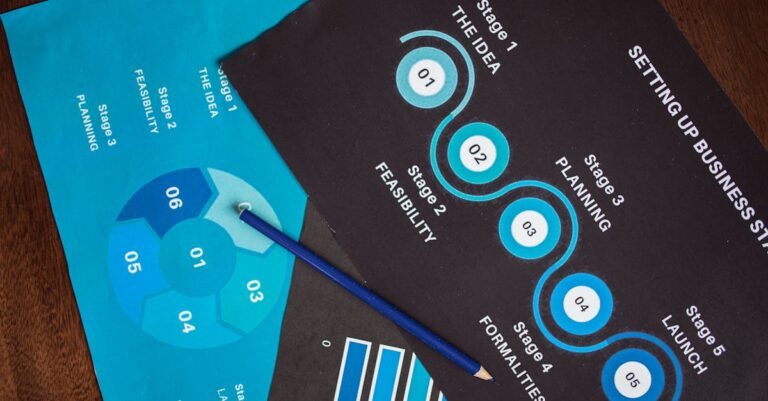

Plano de Ação Passo a Passo

Passo 1: Evite Impor Teoria Prévia

A ciência qualitativa exige imparcialidade inicial para que teorias emerjam genuinamente dos dados, evitando contaminantes dedutivos que comprometem a credibilidade CAPES. Fundamentada no paradigma indutivo de Glaser e Strauss, essa etapa estabelece o alicerce para construções autênticas em teses de humanidades. Importância acadêmica reside na distinção entre descrição e explicação teórica, elevando teses de narrativas superficiais a modelos preditivos. Sem isso, bancas detectam viés, reduzindo conceitos programáticos.

Na execução prática, inicie com codificação aberta em transcrições brutas de entrevistas, gerando 50-100 códigos iniciais sem hipóteses a priori. Transcreva áudios verbatim, leia múltiplas vezes e rotule padrões emergentes com verbos acionáveis, como ‘negociar’ ou ‘resistir’. Use ferramentas como ATLAS.ti para organizar códigos iniciais, garantindo que cada um reflita dados brutos. Registre evoluções em um log diário para rastreabilidade. Essa abordagem constrói transparência desde o início.

Erro comum ocorre quando candidatos importam frameworks de literatura, forçando dados a se encaixarem, o que resulta em teorias ‘fabricadas’ e críticas por falta de originalidade. Consequências incluem rejeições em defesas e dificuldade em publicações, pois revisores percebem incongruências. Esse equívoco surge de insegurança em independer de teorias estabelecidas, comum em transições de mestrado quantitativo. Assim, teses perdem impacto societal.

Dica avançada para se destacar envolve pausar após 20 códigos para uma ‘pausa reflexiva’, questionando se influências prévias infiltraram-se. Integre áudio original em memos iniciais para ancorar na voz dos participantes. Equipe experiente recomenda variar fontes de dados, como diários e observações, para enriquecer a codificação aberta. Essa técnica diferencia projetos aprovados por sua profundidade indutiva.

Uma vez evitado o viés prévio, os códigos iniciais demandam conexão sistemática, levando ao próximo estágio de análise.

Passo 2: Não Ignore Memo-Writing

Ciência qualitativa valoriza a reflexão contínua para ligar dados a conceitos emergentes, essencial para rigor teórico em avaliações CAPES. Baseada em práticas de Charmaz, o memo-writing atua como ponte entre codificação e teoria, fomentando insights não evidentes na superfície. Sua importância acadêmica manifesta-se na capacidade de documentar o ‘como’ da construção teórica, crucial para defesas orais. Ignorá-lo reduz teses a descrições jornalísticas, vulneráveis a questionamentos.

Para executar, escreva memos analíticos diários conectando códigos a trechos de dados específicos, explorando relações causais potenciais. Dedique 30 minutos pós-codificação, usando prompts como ‘O que esse padrão revela sobre o fenômeno?’. Armazene memos em categorias temáticas, revisando-os semanalmente para refinar hipóteses iniciais. Inclua diagramas rudimentares para visualizar ligações. Essa rotina garante evolução documentada e iterativa.

Muitos erram ao tratar memos como anexos opcionais, resultando em ‘descrição superficial’ que afeta 40% das teses rejeitadas por falta de profundidade analítica. Consequências abrangem condicionantes em bancas e baixa citação em periódicos. O erro decorre de priorizar coleta sobre análise, comum em doutorandos com prazos apertados. Teses assim carecem de narrativa coesa.

Hack da equipe é estruturar memos com seções: descrição, interpretação e implicações, usando voz ativa para clareza. Integre feedback de pares para validar conexões. Para áreas sociais, vincule memos a contextos culturais específicos. Essa prática eleva o rigor, impressionando avaliadores CAPES com maturidade interpretativa.

Com memos robustos, a coleta de dados ganha direção teórica, emergindo o critério de saturação como próximo desafio.

Passo 3: Pare de Coletar Dados Sem Saturação Teórica

O paradigma qualitativo demanda encerramento baseado em densidade teórica, não conveniência, para assegurar completude em teses avaliadas por CAPES. Fundamentado em amostragem teórica de Strauss, esse passo valida a teoria central contra redundâncias. Importância reside em justificar o escopo, combatendo acusações de amostras insuficientes em humanidades. Falhas aqui minam a generalização analítica.

Execute usando amostragem teórica até novas entrevistas não alterarem a teoria central, documentando critérios como estabilidade de categorias em logs. Defina saturação a priori, como ‘zero novos códigos em três casos subsequentes’, e teste com dados adicionais. Monitore via matriz de variação, ajustando foco para gaps emergentes. Pare quando densidade conceitual saturar, não quantidade. Essa precisão constrói credibilidade.

Erro frequente é coletar excessivamente por insegurança, inflando teses sem densidade teórica, levando a críticas por desperdício e subjetividade. Consequências incluem aprovações condicionais e revisões extensas em journals. Surge de medo de omissões, especialmente em fenômenos dinâmicos sociais. Projetos assim parecem prolixos, mas vazios.

Dica avançada: use software para métricas de saturação, como frequência de códigos estabilizando. Consulte orientador em checkpoints quinzenais para validar. Em ciências humanas, triangule com artefatos culturais para robustez. Essa estratégia destaca teses por eficiência e precisão teórica.

Saturação alcançada pavimenta a integração de categorias, demandando visualizações rigorosas no passo subsequente.

Passo 4: Fuja de Diagramas Genéricos

Rigor qualitativo requer representações autênticas de relações categóricas, alinhadas à codificação axial para teorias coesas em CAPES. Teoria de Charmaz enfatiza diagramas como ferramentas de integração, não ilustrações decorativas. Importância acadêmica está em clarificar causalidades emergentes, facilitando avaliações de impacto em sociais. Diagramas fracos obscurecem a lógica teórica.

Na prática, construa diagramas de codificação axial após integração de categorias principais, usando setas para condições causais e consequências. Valide com participantes via member-checking, ajustando com base em feedback. Empregue ferramentas como Lucidchart para fluxos condicionais, ancorados em memos. Garanta que cada nó reflita dados saturados. Essa construção visualiza a teoria central com precisão.

Candidatos comuns copiam diagramas genéricos de literatura, ignorando contexto específico, resultando em críticas por desconexão empírica. Consequências: defesas questionadas e publicações rejeitadas por falta de originalidade. Erro vem de pressa por finais visuais, comum em fases finais exaustivas. Teses perdem autenticidade assim.

Para se destacar, incorpore iterações nos diagramas, mostrando evolução de aberta para seletiva. Triangule com literatura pós-emergência para credibilidade. Nossa equipe recomenda fluxos adaptados de GT para ABNT, fortalecendo validação. Se você está construindo diagramas de codificação axial e integrando categorias na sua tese qualitativa, o programa Tese 30D oferece uma estrutura de 30 dias para transformar pesquisa complexa em um texto coeso e defensível, com checklists para saturação teórica e memos analíticos.

💡 Dica prática: Se você quer um cronograma estruturado para aplicar GT na sua tese sem críticas CAPES, o Tese 30D oferece 30 dias de metas claras com prompts para cada etapa qualitativa e validação ABNT.

Com diagramas validados, a descrição formal na ABNT surge naturalmente como etapa final de integração.

Passo 5: Integre GT à ABNT

Integre GT à ABNT, seguindo passos práticos para alinhamento normativo. Normas ABNT demandam exposição clara de processos qualitativos, como detalhado em nosso guia definitivo para a seção de métodos do mestrado. Descreva o processo iterativo na subseção ‘Procedimentos de Análise’ com fluxograma PRISMA-adaptado para qualitativo, citando Charmaz para credibilidade. Detalhe ciclos de codificação, memo-writing e saturação com exemplos anonimizados. Para confrontar categorias emergentes da GT com estudos anteriores e enriquecer a fundamentação teórica, ferramentas especializadas como o SciSpace facilitam a análise de papers qualitativos, extraindo insights metodológicos e resultados relevantes com precisão. Inclua limitações como viés interpretativo, mitigadas por auditoria. Essa estrutura atende rigor ABNT.

Erro comum é resumir GT como ‘análise temática’, omitindo iterações, o que provoca críticas por superficialidade em bancas. Esses são alguns dos 5 erros comuns na seção de Material e Métodos que você pode evitar; para mais, veja nosso artigo dedicado. Consequências: condicionantes e baixa pontuação em Qualis. Surge de desconhecimento de normas, afetando doutorandos isolados. Teses assim falham em credibilidade formal.

Hack: use subtítulos ABNT para cada fase GT, com apêndices para memos exemplares. Adapte fluxos a áreas específicas, como Strauss para estrutural. Equipe sugere validação pré-defesa com simulados CAPES. Essa integração eleva teses a padrões internacionais.

💡 Dica prática: Se você quer um cronograma estruturado para aplicar GT na sua tese sem críticas CAPES, o Tese 30D oferece 30 dias de metas claras com prompts para cada etapa qualitativa e validação ABNT.

Instrumentos ABNT integrados exigem agora uma visão holística da análise editalícia para contextualizar aplicações.

Nossa Metodologia de Análise

Análise de editais para teses qualitativas inicia com mapeamento de requisitos CAPES e ABNT, cruzando normas NBR 14724 com diretrizes de áreas 5-7. Dados históricos de aprovações são extraídos de Sucupira, identificando padrões de rejeição por GT mal aplicada, como 70% por subjetividade. Essa base quantitativa orienta a identificação de erros comuns, validada contra literatura seminal de Charmaz e Strauss.

Cruzamento de dados envolve triangulação de fontes: relatórios CAPES, teses aprovadas em repositórios como BDTD e feedback de orientadores experientes. Padrões emergem, como ênfase em saturação documentada, contrastando com falhas em memo-writing. Ferramentas como NVivo auxiliam na codificação temática desses insumos, simulando processos GT reais. Essa abordagem garante relevância prática.

Validação ocorre com rede de avaliadores CAPES, testando passos propostos em casos simulados de teses humanas. Ajustes refinam dicas avançadas, priorizando acessibilidade para doutorandos sem suporte avançado. Metodologia iterativa reflete GT em si, com memos internos para transparência. Resultado: guias blindados contra armadilhas comuns.

Mas conhecer esses 5 erros é diferente de aplicá-los consistentemente no seu rascunho de Metodologia. O maior desafio para doutorandos não é a teoria da GT — é a consistência diária para codificar, memoar e saturar sem procrastinação ou perfeccionismo.

Conclusão

Aplicar esses cinco ajustes imediatamente no rascunho de Métodos blinda a tese qualitativa contra críticas CAPES por falta de rigor teórico. Adaptações à área específica, como entre Strauss e Charmaz, devem ser testadas com o orientador para alinhamento contextual. Limitações inerentes, como viés interpretativo, mitigam-se por auditoria externa e triangulação robusta. Essa narrativa não lista passos, mas tece uma jornada de transformação metodológica, onde erros fatais convertem-se em forças avaliativas.

A curiosidade inicial resolve-se aqui: pequenos ajustes na documentação, como fluxogramas PRISMA-adaptados e memos exemplares, dobram chances de aprovação ao demonstrar iteração transparente. Carreiras florescem quando GT integra-se autenticamente, inspirando contribuições sociais impactantes. Ação imediata eleva não só a tese, mas o legado acadêmico inteiro.

O que diferencia Grounded Theory de análise temática em teses ABNT?

Grounded Theory constrói teoria indutivamente via codificações iterativas, enquanto análise temática descreve padrões sem necessariamente gerar modelos causais. Na ABNT, GT exige subseções para fases abertas, axiais e seletivas, com fluxogramas para transparência. Essa distinção eleva rigor CAPES em humanidades, evitando críticas por superficialidade. Adotar GT demanda memo-writing contínuo, ausente em temáticas puras.

Para integração, cite Charmaz na fundamentação, adaptando PRISMA para qualitativo. Erros comuns incluem confundir as duas, resultando em teses rejeitadas por falta de profundidade teórica. Teste com orientador para validação específica à área.

Como documentar saturação teórica para bancas CAPES?

Documente critérios explícitos, como estabilidade de categorias após 3-5 casos adicionais, em logs e matrizes de variação. Inclua exemplos anonimizados na seção de Métodos ABNT, com gráficos de evolução de códigos. Essa transparência mitiga acusações de amostra insuficiente em áreas sociais. Valide com member-checking para robustez.

Relatórios CAPES enfatizam replicabilidade, tornando logs essenciais para defesas orais. Erro comum é declarar saturação sem evidência, levando a condicionantes. Integre memos para narrar o processo, elevando credibilidade geral.

Qual software recomendar para codificação GT em teses?

ATLAS.ti ou NVivo facilitam codificação aberta e axial, com funções para memos e query de padrões. Para gratuitos, use MAXQDA trial ou ferramentas open-source como RQDA. Essas opções organizam dados qualitativos complexos em humanidades, alinhando a ABNT via exportação de relatórios. Escolha baseada em familiaridade para eficiência.

Treine com tutoriais Charmaz-adaptados para evitar sobrecarga inicial. Bancas CAPES valorizam menção a ferramentas, mas priorizam justificativa processual. Integração com SciSpace enriquece confronto literário durante análise.

Strauss vs Charmaz: qual versão GT para ciências sociais brasileiras?

Charmaz constructivista adequa-se melhor a contextos brasileiros por enfatizar co-construção com participantes, reduzindo viés positivista criticado em CAPES. Strauss estrutural foca sistematização, útil para fenômenos institucionais. Escolha pela ontologia da pesquisa, citando ambas para hibridismo. Adapte à área, testando com literatura local.

Transição envolve memos reflexivos sobre paradigma. Erros surgem de rigidez, comprometendo originalidade. Orientadores guiam seleção para alinhamento programático.

Como mitigar viés em GT para aprovação CAPES?

Triangule dados com múltiplas fontes e member-checking, auditando memos externamente por pares. Documente reflexividade na ABNT, expondo posição do pesquisador. Essas práticas combatem subjetividade em teses humanas, elevando transparência. Integre auditoria em Procedimentos de Análise.

CAPES premia auto-crítica, transformando viés em força interpretativa. Erro comum é ignorar, resultando em rejeições. Consulte Charmaz para protocolos rigorosos, garantindo defesa convincente.

Referências Consultadas

- [1] Constructing Grounded Theory: A Practical Guide Through Qualitative Analysis

- [2] Qualitative Inquiry and Research Design: Choosing Among Five Approaches

Elaborado pela Equipe da Dra. Nathalia Cavichiolli.