Você já sentiu que sua seção de métodos parece vaga, confunde avaliadores e atrasa publicação? Esse é o problema mais comum entre graduandas que querem entrar no mestrado: falta de hipótese clara, métodos pouco replicáveis e documentação insuficiente. Aqui você aprende passos práticos para resolver isso.

Prometo mostrar como transformar perguntas em hipóteses falsificáveis, descrever procedimentos com replicabilidade e anexar artefatos que aumentam credibilidade. Baseio-me em orientações consolidadas sobre método e reprodutibilidade e em práticas de reporte usadas por periódicos e agências [F1] [F2]. Nas seções abaixo você encontrará explicações curtas, evidências e checklists aplicáveis.

Dominar o método científico na redação significa escrever hipóteses testáveis, detalhar amostra e procedimentos, indicar softwares e parâmetros, e anexar scripts ou protocolos. Faça isso e sua seção de métodos vira uma defesa, não um risco editorial.

Perguntas que vou responder

- Por que a seção de métodos é tão decisiva?

- Como transformar uma pergunta em hipótese testável?

- Como descrever procedimentos para que sejam replicáveis?

- Quais métricas, softwares e seeds devo declarar?

- Como documentar limitações e análises de sensibilidade?

- Quem deve assumir quais responsabilidades no processo?

Por que a seção de métodos é tão decisiva?

Conceito em 1 minuto

A seção de métodos especifica o que foi medido, como e por que. Sem ela, leitores não conseguem avaliar validade interna, nem reproduzir resultados. Em resumo, é a espinha dorsal da credibilidade acadêmica.

O que os dados mostram [F2]

Relatórios de agências e editoras apontam que falhas de reprodutibilidade e documentação são causas frequentes de rejeição e retratação. Investidores e avaliadores de projetos também usam critérios metodológicos para decidir financiamento [F2].

Checklist rápido para revisão da sua seção de métodos

- Defina hipóteses como declarações falsificáveis, com variáveis dependentes e independentes claras.

- Separe subseções: participantes/amostra, materiais, procedimentos, análises.

- Informe softwares, versões, parâmetros e seeds.

- Descreva critérios de inclusão e exclusão, amostra final e cálculo de tamanho amostral.

Cenário onde não funciona: se seu estudo é puramente exploratório, impor hipóteses rígidas pode ser equivocado. Nesse caso, documente decisões exploratórias e planejamentos para estudos confirmatórios futuros.

Como transformar uma pergunta em hipótese testável?

Conceito em 1 minuto

Pergunta é ampla; hipótese é uma afirmação específica que pode ser aceita ou rejeitada por dados.

Exemplo prático na literatura [F1]

Modelos didáticos mostram transformações de perguntas em hipóteses que guiam desenho experimental e amostragem. Seguir esse roteiro facilita escolher instrumentos e análises apropriadas [F1].

Passo a passo para formular hipótese

- Traduza a pergunta em variáveis mensuráveis.

- Especifique unidade de observação e escala de medida.

- Declare a previsão esperada e a métrica de teste (ex.: diferença média, razão de chances, correlação).

Cenário onde não funciona: quando não há teoria prévia suficiente. Se for o caso, prefira hipóteses nulas e secundárias exploratórias, e deixe claro que testes são preliminares.

Como descrever procedimentos para que sejam replicáveis?

Conceito em 1 minuto

Replicabilidade exige ordem, precisão e transparência: materiais, protocolos e tempo de execução descritos de forma que outro pesquisador repita passo a passo.

Exemplo autoral: reescrevendo um método de mestrado

Em uma orientação recente, reescrevi a seção de métodos trocando frases vagas por passos numerados, anexando script R e tabela de amostragem. O número de comentários dos revisores sobre clareza caiu significativamente na primeira rodada.

Passos práticos para documentar protocolos

- Use verbos no passado para ações realizadas e incluya tempos e condições.

- Anexe scripts, planilhas e um fluxograma do procedimento como material suplementar.

- Adote checklists internos e registre versões de protocolos.

Cenário onde não funciona: estudos com dados sensíveis (p.ex., clínicos) podem ter restrições éticas. Neste caso, descreva o protocolo em detalhe, mas disponibilize apenas meta-dados e procedimentos de acesso controlado.

Quais métricas, softwares e seeds devo declarar?

Conceito em 1 minuto

Declarar métricas e ferramentas permite reproduzir análises. Seeds (sementes) garantem reprodutibilidade de amostragens e procedimentos estocásticos.

O que os guias recomendam [F3]

Redes de guidelines indicam listar software, versão, pacotes e parâmetros, além de scripts de análise para submissão suplementar. Essas práticas aceleram revisão e aceitação [F3].

Template rápido para a seção de análises

- Software: nome e versão.

- Pacotes e funções usadas, com parâmetros críticos.

- Seed utilizada para reprodutibilidade e nota sobre randomização.

- Planos de tratamento de dados ausentes e análises de sensibilidade.

Cenário onde não funciona: se você utiliza ferramentas proprietárias que impedem divulgação de código. Ainda assim, documente comandos, parâmetros e outputs esperados, e ofereça dados agregados ou via repositório com acesso controlado.

Como documentar limitações e análises de sensibilidade?

Conceito em 1 minuto

Limitações não enfraquecem seu trabalho quando são honestas e acompanhadas de análises que testam a robustez dos resultados.

O que os estudos e guias sugerem [F1]

Publicações sobre metodologia recomendam incluir análises de sensibilidade e critérios de qualidade, além de planos para dados ausentes e viés de seleção [F1].

Checklist para limitações e sensibilidade

- Liste suposições implícitas no desenho.

- Rode pelo menos duas análises de sensibilidade e relate diferenças.

- Forneça scripts para reproduzir essas análises.

Cenário onde não funciona: quando limitações são estruturais, p.ex., amostra pequena e não representativa. Então, reformule as inferências como exploratórias e proponha estudos confirmatórios.

Quem deve assumir quais responsabilidades?

Conceito em 1 minuto

Boas práticas exigem divisão clara de tarefas: autor principal, orientador, estatístico e técnico devem ter papéis documentados.

O que a literatura indica [F5]

Artigos sobre cultura de pesquisa defendem que liderança, documentação por discentes e suporte institucional são essenciais para manter protocolos reprodutíveis e auditáveis [F5].

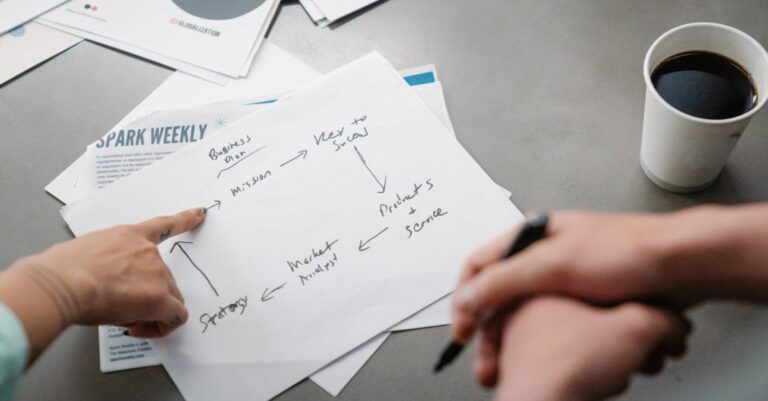

Mapa de responsabilidades em 5 passos

- Autor principal: redigir métodos e anexar scripts.

- Orientador: revisar lógica, hipóteses e conformidade ética.

- Estatístico: validar análises e planos de sensibilidade.

- Técnico/bibliotecário: organizar repositórios e metadados.

- Coordenação: treinar e auditar práticas periodicamente.

Cenário onde não funciona: grupos muito pequenos sem suporte técnico. Nesses casos, busque colaboração ou serviços institucionais de estatística antes da submissão.

Como validamos

Validamos o conteúdo com revisão de guias reconhecidos e práticas adotadas por periódicos e agências, além de aplicação prática na orientação de teses. Consultei recomendações sobre documentação de métodos e reprodutibilidade [F1] [F2] e guidelines de reporte [F3], além de análises sobre responsabilidade institucional [F5]. Estas fontes orientaram os checklists e templates sugeridos.

Conclusão: resumo e primeiro passo

Resumindo, transforme intenção investigativa em hipóteses claras, escreva métodos em subseções ordenadas, declare softwares e parâmetros, e anexe scripts e protocolos quando possível. Ação prática imediata: reescreva sua seção de métodos na sequência amostra → instrumentos → procedimento → análises e anexe um arquivo com scripts.

Recurso institucional recomendado: consulte os guias da sua instituição e os requisitos da CAPES ao preparar projetos e teses [F4].

FAQ

Preciso sempre anexar código e dados?

Sempre que possível, anexe código e dados para maximizar transparência e facilitar revisão. Se houver restrições éticas ou legais, anexe scripts e metadados e ofereça acesso controlado com termos de uso claros. Próximo passo: verifique políticas da sua instituição e prepare um pacote com scripts, metadados e instruções de acesso.

Como definir o tamanho da amostra sem experiência prévia?

Use referências da literatura e cálculos de potência para fundamentar o tamanho amostral. Quando houver incerteza, planeje análises de sensibilidade para testar robustez. Próximo passo: consulte um estatístico e rode simulações ou cálculos de potência antes de finalizar o protocolo.

E se meu orientador não pedir detalhes suficientes?

Propor um rascunho com checklists reduz retrabalhos e facilita revisão interna. Fornecer um template mostra o ganho prático em clareza e agilidade. Próximo passo: entregue um esboço de métodos com subseções e checklists para discussão na próxima reunião.

Quanto tempo leva documentar métodos com qualidade?

Depende do estudo, mas construir protocolos e anexar scripts costuma economizar tempo na revisão. Reserve blocos dedicados de 2 a 4 horas por seção para o detalhamento inicial. Próximo passo: agende sessões de 2–4 horas para cada subseção (amostra, instrumentos, procedimento, análises).

Como lidar com dados sensíveis ao disponibilizar materiais?

Descreva procedimentos e disponibilize metadados; use repositórios com controle de acesso ou termos de uso para proteger participantes. Quando necessário, ofereça acesso controlado mediante solicitação formal. Próximo passo: prepare um plano de compartilhamento que inclua metadados e contatos para solicitação de acesso.

Elaborado pela Equipe da Dra. Nathalia Cavichiolli.

Dra. Nathalia Cavichiolli — PhD pela USP, com dois pós-doutorados; MBA em Gestão e Docência; experiência internacional na The Ohio State University (EUA); revisora de periódicos científicos pela Springer Nature, com atuação em 37+ revistas, incluindo a Nature; especialista em escrita acadêmica há 15+ anos; pioneira no uso de IA para escrita científica no Brasil; 2.800+ alunos impactados no Brasil e em 15+ países.

Referências

- [F1] – https://journals.plos.org/ploscompbiol/article?id=10.1371/journal.pcbi.1004205

- [F2] – https://grants.nih.gov/policy/reproducibility/index.htm

- [F3] – https://www.equator-network.org/

- [F5] – https://journals.plos.org/ploscompbiol/article?id=10.1371/journal.pcbi.1003285

- [F4] – https://www.gov.br/capes/pt-br

Atualizado em 24/09/2025