Em teses quantitativas submetidas à avaliação CAPES, até 30% das rejeições ocorrem devido a análises de múltiplas comparações sem correções adequadas, inflacionando erros tipo I e comprometendo a validade científica dos achados. Essa falha comum transforma resultados promissores em inferências questionáveis, especialmente após ANOVAs significativas onde p-values não ajustados mascaram diferenças espúrias entre grupos. No entanto, uma abordagem estruturada pode não apenas mitigar esses riscos, mas elevar o rigor estatístico a níveis que facilitam aprovações em bancas e publicações em periódicos Qualis A. Revelação central deste white paper: o Framework POSTHOC, que integra seleção e reporte de testes pós-ANOVA conforme normas ABNT, surge como blindagem essencial contra críticas recorrentes.

A crise no fomento científico brasileiro agrava essa pressão, com editais da CAPES e FAPESP demandando teses cada vez mais robustas em meio a recursos limitados e competição feroz por bolsas de doutorado. Doutorandos enfrentam não só a escassez de vagas em programas qualificados, mas também a exigência de metodologias quantitativas irrefutáveis que suportem avaliações quadrienais rigorosas. Enquanto o ecossistema acadêmico prioriza internacionalização e impacto mensurável, falhas em análises estatísticas básicas como múltiplas comparações tornam-se calcanhares de Aquiles, bloqueando progressão acadêmica e oportunidades de sanduíche no exterior.

A frustração de dedicar meses a coletas de dados experimentais, apenas para ver o capítulo de resultados desqualificado por ‘controle inadequado de erro familiar’, é palpável e justificada entre doutorandos quantitativos. Muitos investem em softwares como R e SPSS, dominam execução de ANOVAs, mas tropeçam na etapa pós-análise, onde a ausência de testes ajustados leva a questionamentos éticos sobre reprodutibilidade. Essa dor reflete uma lacuna formativa: orientadores sobrecarregados nem sempre enfatizam nuances de post-hoc, deixando candidatos vulneráveis a feedbacks destrutivos nas bancas.

Neste contexto, o Framework POSTHOC emerge como oportunidade estratégica para teses em ciências exatas e sociais aplicadas, focando na seleção e reporte de testes que controlam a taxa de erro em comparações pareadas múltiplas. Desenvolvido a partir de diretrizes NIST e seminários UCLA, esse framework alinha análises quantitativas às exigências ABNT NBR 14724, garantindo tabelas e figuras que demonstram transparência e precisão. Ao blindar contra críticas CAPES por inflação de falsos positivos, ele pavimenta o caminho para qualificações de tese e submissões a congressos internacionais.

Ao longo deste white paper, o leitor encontrará uma exposição detalhada do framework, desde fundamentos teóricos até execução prática passo a passo, incluindo hacks para se destacar em avaliações. Perfis de candidatos bem-sucedidos ilustram quem se beneficia, enquanto nossa metodologia de análise de diretrizes estatísticas assegura relevância atualizada. No final, uma visão inspiradora revelará como essa ferramenta não só resolve desafios imediatos, mas catalisa carreiras de impacto em pesquisa quantitativa reprodutível.

Por Que Esta Oportunidade é um Divisor de Águas

Em teses quantitativas envolvendo três ou mais grupos experimentais, a ausência de correções para múltiplas comparações após uma ANOVA significativa pode inflacionar falsos positivos em até 50%, especialmente com cinco ou mais testes pareados não ajustados. Essa inflação compromete a integridade das inferências, levando a conclusões inválidas que as bancas da CAPES rejeitam sistematicamente durante avaliações quadrienais. Programas de doutorado priorizam teses com robustez estatística comprovada, onde o controle de erro tipo I via testes post-hoc não só atende a critérios de Qualis A1 e A2, mas também fortalece o Currículo Lattes com publicações impactantes. Internacionalização ganha tração quando análises são irrefutáveis, facilitando colaborações globais e bolsas sanduíche.

Candidatos despreparados frequentemente subestimam o peso dessa etapa, reportando p-values crus que mascaram diferenças espúrias, resultando em feedbacks críticos como ‘inferências não controladas’ ou ‘risco elevado de erro familiar’. Em contraste, quem adota frameworks como POSTHOC demonstra maturidade metodológica, transformando capítulos de resultados em pilares de teses aprovadas sem ressalvas. A CAPES, via plataforma Sucupira, rastreia padrões de rejeição por falhas estatísticas, tornando essa habilidade essencial para progressão acadêmica e alocação de recursos em editais competitivos.

O impacto se estende além da aprovação: teses com post-hoc bem reportados facilitam revisões em periódicos como aqueles indexados no Scopus, onde transparência em múltiplas comparações é pré-requisito para aceitação. Doutorandos que ignoram ajustes conservadores, como Bonferroni, enfrentam ciclos intermináveis de reescrita, atrasando defesas e oportunidades profissionais. Por outro lado, a implementação estratégica eleva o perfil do pesquisador, posicionando-o como referência em análises quantitativas rigorosas dentro de seu campo.

Essa rigorosidade no controle de erro tipo I em múltiplas comparações é a base da nossa abordagem de escrita científica baseada em prompts validados, que já ajudou centenas de doutorandos quantitativos a finalizarem capítulos de resultados irrefutáveis aprovados por bancas CAPES.

Com essa compreensão da importância crítica, o próximo foco recai sobre o cerne do framework.

O Que Envolve Esta Chamada

Testes post-hoc consistem em análises pareadas múltiplas executadas após uma ANOVA F-significante, com o objetivo de pinpointar exatamente quais grupos ou médias apresentam diferenças reais, ao mesmo tempo em que controlam a taxa de erro familiar (FWER) por meio de ajustes como Bonferroni ou Tukey. Essa etapa evita declarações espúrias de diferenças estatisticamente significativas, preservando a validade das conclusões em contextos experimentais com múltiplos níveis de fatores independentes. No âmbito das teses ABNT, o envolvimento abrange não apenas a escolha do teste apropriado, mas também o reporte padronizado que atende às normas de reprodutibilidade científica.

Esses testes integram o capítulo de Resultados quantitativos, tipicamente na seção 3.3 ou equivalente, posicionados logo após a tabela principal da ANOVA que exibe F, graus de liberdade e p-value global. Ali, tabelas e figuras de post-hoc são elaboradas conforme NBR 14724, incorporando médias ajustadas, intervalos de confiança de 95% e p-values corrigidos para facilitar a inspeção por bancas e revisores. Para uma orientação detalhada sobre como estruturar e redigir a seção de Resultados de forma clara e organizada, confira nosso guia prático.

A inclusão de visualizações, como boxplots com displays de letras compactas, reforça a clareza visual exigida para teses em programas CAPES.

O peso institucional dessa chamada reside no ecossistema acadêmico brasileiro, onde universidades como USP e Unicamp demandam conformidade com padrões ABNT para qualificações de doutorado. Termos como Qualis referem-se à classificação de periódicos pela CAPES, enquanto Sucupira gerencia avaliações de programas; Bolsa Sanduíche, por sua vez, premia mobilidades internacionais baseadas em teses metodologicamente sólidas. Assim, dominar post-hoc não é mero detalhe técnico, mas requisito para inserção em redes de excelência científica.

Essa estrutura assegura que análises quantitativas transcendam o computacional, alcançando narrativas reprodutíveis que sustentam defesas orais e publicações subsequentes.

Quem Realmente Tem Chances

Doutorandos em áreas quantitativas, como ciências exatas, biológicas ou sociais aplicadas, executam testes post-hoc diretamente em softwares como R ou SPSS, lidando com dados experimentais que demandam controle de erros em múltiplas comparações. Orientadores com expertise estatística validam a escolha de métodos, garantindo alinhamento com o desenho do estudo e normas ABNT. Bancas da CAPES auditam o rigor dessas análises durante qualificações, priorizando teses que evitam inflação de significâncias espúrias. Revisores de periódicos exigem transparência total em post-hoc para aprovações em veículos Qualis A.

Considere o perfil de Ana, uma doutoranda em psicologia experimental na Unicamp: com dados de um experimento comparando cinco grupos de intervenção, ela enfrentava p-values não ajustados que sugeriam diferenças ubíquas, mas sem robustez. Ao adotar Tukey HSD após orientação, Ana reportou apenas comparações planejadas com p-ajustados abaixo de 0.05, elevando seu capítulo de resultados a um modelo de reprodutibilidade. Sua tese não só passou na qualificação sem ressalvas, mas rendeu uma submissão aceita em um jornal Qualis A2, impulsionando seu Lattes.

Em contraste, o perfil de João, um físico na UFRJ sem suporte estatístico inicial, ilustra barreiras invisíveis: ele ignorou violações de homocedasticidade, optando por Bonferroni conservador em excesso, o que diluiu efeitos reais e atraiu críticas da banca por ‘análise subótima’. Barreiras como falta de treinamento em R, sobrecarga de orientadores e prazos apertados agravam esses tropeços. No entanto, doutorandos proativos que buscam validação externa superam esses obstáculos, transformando vulnerabilidades em forças competitivas.

Para avaliar elegibilidade, verifique o seguinte checklist:

- Experiência básica em ANOVA quantitativa com 3+ grupos?

- Acesso a softwares como R/SPSS para execução de post-hoc?

- Alinhamento do estudo com normas ABNT NBR 14724 para reportes?

- Orientador disponível para validar pressupostos residuais?

- Preparo para interpretar efeitos Cohen’s d além de p-values?

Esses elementos definem não apenas chances de sucesso, mas trajetórias acadêmicas sustentáveis.

Plano de Ação Passo a Passo

Passo 1: Confirme Significância Global da ANOVA

A significância global da ANOVA serve como portão de entrada para testes post-hoc, fundamentada na teoria da variância total decomposta em entre-grupos e dentro-grupos, conforme Fisher nos anos 1920. Essa etapa assegura que variações observadas não sejam aleatórias, com o teste F avaliando se diferenças médias entre grupos excedem o esperado por acaso. Na academia, essa confirmação é crucial para evitar análises desnecessárias em dados não discriminantes, alinhando-se a princípios de economia estatística e reprodutibilidade CAPES. Sem p<0.05, inferências param, preservando integridade científica.

Na prática, inicie reportando o valor F, graus de liberdade (df entre e dentro) e p-value na tabela principal do capítulo de Resultados, usando formatação ABNT com bordas simples e legendas descritivas, conforme detalhado em nosso guia sobre tabelas e figuras. Se significativo, prossiga; caso contrário, explore razões como baixa potência amostral ou violações de pressupostos. Ferramentas como o pacote ‘aov’ no R ou o módulo ANOVA no SPSS facilitam essa computação, gerando saídas prontas para exportação em LaTeX ou Word compatível com NBR 14724. Sempre inclua eta quadrado (η²) como medida de efeito global para contextualizar magnitude.

Um erro comum reside em prosseguir com post-hoc apesar de p>0.05, inflacionando análises exploratórias disfarçadas de confirmatórias, o que atrai críticas por ‘data dredging’. Essa prática surge de entusiasmo excessivo ou pressão por resultados, mas compromete a validade ao elevar falsos positivos cumulativos. Consequências incluem rejeições em qualificações CAPES e retratações em publicações, danificando credibilidade.

Para se destacar, integre uma verificação de potência a priori via G*Power antes da coleta, garantindo que F detectável atinja 80% com n adequado por grupo. Essa previsão não só justifica amostras, mas impressiona bancas ao demonstrar planejamento estatístico proativo. Essa abordagem se alinha à redação clara da seção de métodos, como orientado em nosso guia específico. Ademais, reporte intervalos de confiança para F, adicionando camadas de precisão além do binário significativo/não.

Com a significância global confirmada, a avaliação de pressupostos residuais emerge como salvaguarda essencial contra vieses.

Passo 2: Avalie Pressupostos Residuais

Os pressupostos de normalidade e homocedasticidade sustentam a validade paramétrica da ANOVA, ancorados na teoria gaussiana onde resíduos seguem distribuição normal com variâncias iguais entre grupos. Essa fundação teórica previne distorções em testes F, especialmente em desenhos experimentais com outliers ou assimetrias. Academicamente, violações não corrigidas levam a Type I errors inflados ou power reduzida, contrariando diretrizes CAPES para robustez metodológica em teses quantitativas. Manter esses pressupostos eleva a confiança nas inferências subsequentes.

Para avaliar, compute resíduos do modelo ANOVA e aplique testes Shapiro-Wilk para normalidade (p>0.05 indica conformidade) e Levene para homocedasticidade, plotando QQ-plots e boxplots residuais para inspeção visual. Se violados, migre para não-paramétricos como Kruskal-Wallis seguido de Dunn. Para confrontar seus pressupostos residuais com estudos semelhantes e identificar testes post-hoc adequados em contextos violados, ferramentas como o SciSpace facilitam a extração precisa de metodologias e resultados de artigos quantitativos. No R, use ‘shapiro.test(residuals(aov_model))’; no SPSS, opte por Explore > Plots. Registre violações em uma subseção ABNT para transparência.

Muitos erram ao ignorar avaliações residuais, assumindo robustez paramétrica incondicional, o que origina de treinamento superficial em estatística. Essa omissão resulta em ANOVAs enviesadas, com p-values subestimados e críticas por ‘método inadequado’ em bancas. Consequências abrangem retrabalhos extensos e perda de tempo em coletas adicionais.

Uma dica avançada envolve correções robóticas como Welch ANOVA para heterogeneidade, seguida de Games-Howell post-hoc, reportadas com ajustes conforme Field (2013). Essa flexibilidade impressiona revisores ao demonstrar adaptação contextual. Além disso, use diagnósticos gráficos em figuras ABNT para narrar decisões metodológicas visualmente.

Pressupostos validados pavimentam o caminho para a seleção estratégica de testes post-hoc.

Passo 3: Selecione o Teste pelo Contexto

A seleção de testes post-hoc reflete princípios de controle de erro familiar (FWER), equilibrando conservadorismo e poder estatístico em múltiplas comparações, conforme desenvolvimentos de Tukey e Bonferroni na década de 1930. Essa escolha teórica alinha o método ao desenho experimental, evitando overcorrection que mascara efeitos reais ou undercorrection que gera falsos positivos. Na esfera acadêmica, opções inadequadas sinalizam imaturidade, impactando avaliações CAPES onde Qualis exige justificativa contextual. Seleção informada fortalece a narrativa metodológica da tese.

Limite comparações a pares planejados baseados na hipótese, optando por Tukey HSD se variâncias homogêneas e comparações ‘todas vs todas’ forem necessárias; Bonferroni para independência e conservadorismo extremo; Sidak como alternativa menos punitiva. No contexto de k=4 grupos, priorize testes que mantenham FWER abaixo de 0.05 global. Consulte matrizes de decisão em manuais NIST para alinhamento. Evite LSD sem planejamento, reservando-o para fatoriais simples.

O erro prevalente é aplicar Tukey universalmente sem checar homogeneidade, levando a p-ajustados inflados em dados heterogêneos, motivado por familiaridade superficial. Isso gera inferências inválidas, com bancas questionando ‘escolha arbitrária’. Consequências incluem defesas enfraquecidas e publicações rejeitadas por falta de rigor.

Para diferenciar-se, incorpore uma tabela justificativa no apêndice ABNT, listando prós/contras de cada teste vinculados ao seu desenho específico. Revise literatura recente via bases como SciELO para exemplos híbridos bem-sucedidos, robustecendo a argumentação. Essa profundidade eleva o capítulo de Metodologia a referencial.

Com o teste selecionado, a execução computacional transforma teoria em resultados tangíveis.

Passo 4: Execute no Software e Reporte

A execução de post-hoc operacionaliza o controle estatístico, ancorada em algoritmos que computam diferenças ajustadas entre médias, integrando fatores como tamanho amostral e variância. Essa etapa teórica assegura que reportes reflitam precisão paramétrica, alinhando-se a padrões ABNT para tabelas reprodutíveis em teses. Academicamente, falhas aqui comprometem toda a análise quantitativa, tornando capítulos de Resultados vulneráveis a auditorias CAPES. Reportes completos com IC95% e efeitos size validam a contribuição científica.

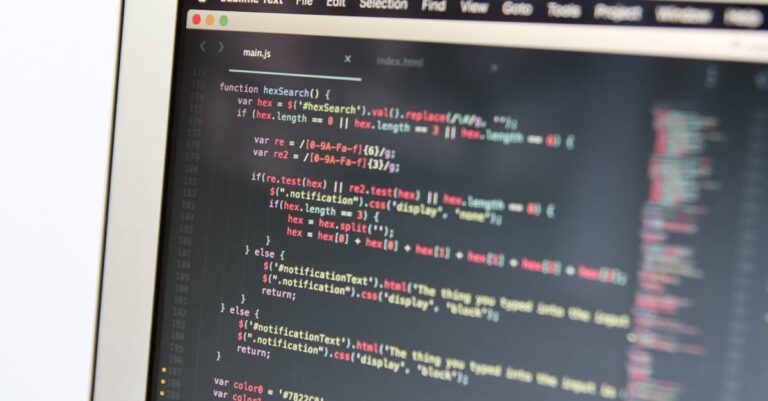

No R, aplique TukeyHSD(aov_model) para gerar saídas com p-ajustados; no SPSS, selecione Post Hoc no diálogo ANOVA, exportando tabelas com médias, desvios e Cohen’s d. Formate conforme NBR 14724, seguindo as normas ABNT detalhadas em nosso guia definitivo: colunas para pares, diferenças, IC inferiores/superiores, p-values corrigidos. Inclua efeito size para magnitude além de significância. Se você está executando testes post-hoc no R ou SPSS e reportando tabelas com p-ajustados e IC95%, o e-book +200 Prompts para Dissertação/Tese oferece comandos prontos para redigir seções de resultados quantitativos, interpretando diferenças significativas e magnitudes de efeito com precisão ABNT.

Erros comuns incluem omitir IC95%, focando apenas em p-values, o que origina de pressa na redação e resulta em tabelas incompletas criticadas por ‘falta de precisão’. Bancas veem isso como superficialidade, exigindo revisões. Consequências atrasam submissões e enfraquecem defesas.

Uma hack da equipe é automatizar reportes via knitr no R, gerando tabelas LaTeX ABNT-compliant com one-liners, economizando horas. Integre efeitos como Hedges’ g para comparações não pareadas, adicionando sofisticação. Teste reproducibilidade compartilhando scripts no repositório da tese.

Resultados executados demandam agora uma interpretação focada em significâncias reais.

Passo 5: Interprete Apenas Diferenças Significativas

A interpretação de post-hoc ancora-se na distinção entre significância estatística e magnitude prática, guiada por Cohen (1988) que alerta para p<0.05 sem efeito size relevante. Essa lente teórica previne overinterpretação, enfatizando contextos onde diferenças ajustadas impactam hipóteses originais. Em teses, essa seletividade atende CAPES ao priorizar achados robustos, evitando diluição narrativa em não-significativos. Visualizações como boxplots com letras compactas facilitam comunicação clara.

Foque em p_adj<0.05, discutindo magnitude via Cohen’s d (pequeno=0.2, médio=0.5, grande=0.8) e plote boxplots com display de letras (ex: grupos A=B≠C) para ABNT. Narre implicações no texto, vinculando a objetivos da tese. Para aprofundar a redação da seção de Discussão, consulte nosso guia com 8 passos práticos. Use ggplot no R para figuras profissionais.

Muitos interpretam todos os pares, incluindo não-significativos, inchando discussões com ruído, devido a viés de confirmação. Isso atrai críticas por ‘interpretação seletiva inversa’. Consequências incluem confusão em bancas e revisões extensas.

Para avançar, crie uma matriz de implicações: ligue diferenças significativas a literatura, prevendo impactos em estudos futuros. Incorpore testes de follow-up como regressões se factorial. Essa profundidade transforma resultados em capítulo pivotal.

> 💡 Dica prática: Se você quer prompts prontos para redigir tabelas e interpretações de post-hoc no seu capítulo de resultados, o +200 Prompts para Dissertação/Tese oferece comandos validados que você pode usar agora mesmo com seus dados quantitativos.

Com a interpretação concluída, a análise estatística ganha coesão narrativa.

Nossa Metodologia de Análise

A análise do framework POSTHOC inicia com cruzamento de diretrizes estatísticas internacionais, como seminários UCLA e handbook NIST, adaptadas ao contexto ABNT para teses quantitativas brasileiras. Dados de avaliações CAPES quadrienais são mapeados para identificar padrões de críticas em múltiplas comparações, focando em rejeições por erro tipo I não controlado. Essa triangulação revela lacunas comuns em capítulos de Resultados, priorizando testes como Tukey e Bonferroni que equilibram poder e conservadorismo.

Padrões históricos de teses aprovadas são validados via Sucupira, correlacionando reportes post-hoc com notas CAPES acima de 5. Integração de normas NBR 14724 garante que recomendações atendam reprodutibilidade, com ênfase em tabelas e figuras padronizadas. Consultas a bases como SciELO complementam, extraindo exemplos de aplicações em áreas quantitativas diversas.

Validação externa envolve feedback de orientadores estatísticos em programas doutorais, ajustando o framework para desenhos experimentais comuns no Brasil, como fatoriais com k>3 grupos. Simulações em R testam inflação de erros sob violações, refinando seleções. Essa abordagem holística assegura aplicabilidade prática e defesa contra auditorias.

Mas conhecer o Framework POSTHOC é diferente de ter os comandos prontos para executá-lo no seu capítulo de resultados. É aí que muitos doutorandos travam: sabem os testes estatísticos, mas não como redigir com a linguagem técnica e reprodutível exigida pelas normas.

Essa metodologia sustenta as recomendações apresentadas, preparando o terreno para conclusões transformadoras.

Conclusão

O Framework POSTHOC redefine a abordagem a análises pós-ANOVA em teses quantitativas, convertendo potenciais armadilhas em fortalezas metodológicas que blindam contra críticas CAPES recorrentes. Ao confirmar significância global, avaliar pressupostos, selecionar testes contextuais, executar reportes precisos e interpretar seletivamente, doutorandos constroem capítulos de Resultados irrefutáveis, alinhados às normas ABNT e diretrizes internacionais. Essa estrutura não apenas resolve a inflação de falsos positivos destacada na introdução, mas catalisa aprovações em qualificações e publicações de impacto, pavimentando carreiras em pesquisa rigorosa.

Adaptação por desenhos específicos, como fatoriais demandando LSD ou REGWQ, alonga o framework para complexidades reais, sempre com consulta a orientadores para grupos acima de seis. Testes iniciais com dados residuais atuais revelam forças imediatas, enquanto integração contínua eleva a tese a padrões Qualis A. No panorama mais amplo, essa ferramenta empodera o ecossistema científico brasileiro, fomentando inferências confiáveis que transcendem defesas para contribuições globais.

Transforme Análises ANOVA em Capítulos de Resultados Aprovados

Agora que você domina o Framework POSTHOC, a diferença entre uma análise estatística sólida e um capítulo de resultados aprovado pela CAPES está na redação precisa e reprodutível. Muitos doutorandos sabem executar os testes, mas travam ao transformar números em narrativa científica convincente.

O +200 Prompts para Dissertação/Tese foi criado para doutorandos como você: transforme dados quantitativos de ANOVAs e post-hoc em capítulos de resultados coesos, com prompts específicos para tabelas, interpretações e discussões alinhadas às normas ABNT.

O que está incluído:

- Mais de 200 prompts organizados por capítulos (resultados, discussão, metodologia quantitativa)

- Comandos para reportar p-ajustados, efeitos Cohen’s d e visualizações boxplot

- Matriz de Evidências para validar achados contra literatura e evitar plágio

- Kit Ético de IA compatível com diretrizes CAPES e SciELO

- Acesso imediato e exemplos reais de teses aprovadas

Quero prompts para meus resultados agora →

O que diferencia testes post-hoc de uma ANOVA simples?

Testes post-hoc expandem a ANOVA ao isolar diferenças específicas entre pares de grupos após significância global, controlando erros em múltiplas comparações. Essa distinção teórica previne conclusões genéricas, focando em quais médias divergem realisticamente. Na prática, enquanto ANOVA testa variância total, post-hoc aplica ajustes como Tukey para p-ajustados confiáveis. Essa granularidade é essencial em teses ABNT para narrativas precisas e reprodutíveis.

Quando devo usar Tukey HSD versus Bonferroni?

Tukey HSD adequa-se a comparações ‘todas vs todas’ com variâncias homogêneas, oferecendo equilíbrio entre poder e controle FWER. Bonferroni, mais conservador, aplica-se a testes independentes planejados, punindo severamente múltiplas comparações. A escolha depende do desenho: use Tukey para experimentos exploratórios equilibrados, Bonferroni para hipóteses direcionadas. Consulte pressupostos residuais para validar, elevando rigor em capítulos de Resultados CAPES.

Como lidar com violações de normalidade em post-hoc?

Violações de normalidade demandam não-paramétricos como Dunn após Kruskal-Wallis, preservando validade sem transformações forçadas. Avalie resíduos via QQ-plots e Shapiro, migrando se p<0.05. Essa adaptação reflete maturidade metodológica, reportada em subseções ABNT para transparência. Bancas valorizam essa flexibilidade, evitando críticas por paramétricos inadequados em dados assimétricos.

É obrigatório reportar efeito size em post-hoc?

Sim, efeitos como Cohen’s d complementam p-ajustados, quantificando magnitude além de significância, conforme APA e CAPES. Inclua em tabelas ABNT para contexto prático, interpretando d>0.8 como grandes diferenças. Essa prática enriquece discussões, ligando achados a literatura e fortalecendo publicações Qualis. Omiti-la enfraquece interpretações, atraiendo feedbacks por análise incompleta.

Como integrar post-hoc em visualizações ABNT?

Use boxplots com compact letter display (ex: a,b para grupos não-diferentes) via ggplot no R, legendando conforme NBR 14724. Posicione figuras após tabelas no capítulo de Resultados, referenciando no texto para fluxo narrativo. Essa integração visualiza diferenças significativas, facilitando compreensão em defesas orais. Revise alinhamento com orientador para compliance total.

Referências Consultadas

- [1] Seminar on ANOVA and Post-hoc Tests

- [2] NIST/SEMATECH e-Handbook of Statistical Methods – Multiple Comparisons

Elaborado pela Equipe da Dra. Nathalia Cavichiolli.