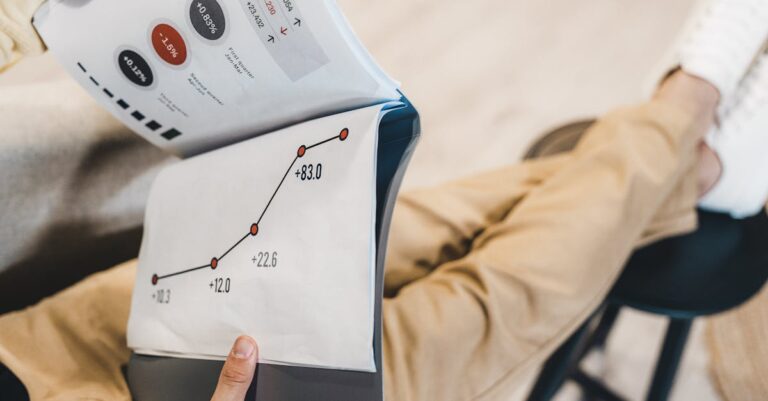

Contraria-se a crença comum de que amostragem qualitativa se resume a conveniência aleatória, pois dados da CAPES revelam que 25% das rejeições em teses de áreas sociais e humanas decorrem de amostras inadequadas ou não justificadas. Essa estatística alarmante destaca como a falta de rigor nesse elemento metodológico compromete anos de pesquisa dedicada. Ao final deste white paper, uma revelação surpreendente sobre o impacto da saturação teórica na pontuação quadrienal CAPES transformará a abordagem à redação de metodologias.

Candidatos enfrentam taxas de reprovação acima de 60% em avaliações preliminares, frequentemente por falhas na seção de amostragem que minam a credibilidade geral do trabalho. Esse cenário exige estratégias precisas para navegar pelas normas ABNT NBR 14724 e 15287, para alinhar perfeitamente sua tese às normas ABNT, consulte nosso guia definitivo em 7 passos, onde a ausência de transparência leva a objeções irremediáveis.

Frustra-se o doutorando ao investir meses em coleta de dados apenas para ver sua tese questionada por banca examinadora ou avaliadores CAPES devido a amostras percebidas como subjetivas ou insuficientes. Essa dor é real e recorrente, especialmente em pesquisas qualitativas onde a profundidade informacional colide com expectativas de representatividade estatística mal entendida. Valida-se essa angústia ao considerar que orientadores sobrecarregados nem sempre guiam adequadamente no refinamento desses critérios, deixando o candidato vulnerável a críticas previsíveis.

Esta chamada representa a oportunidade de alinhar amostragem qualitativa à pergunta de pesquisa, maximizando riqueza informacional e saturação teórica enquanto atende às exigências da CAPES para notas elevadas em avaliações quadrienais. Foca-se na seleção intencional de participantes que priorizem profundidade sobre quantidade, conforme recomendado por autores como Patton e Creswell. Essa abordagem estratégica não só reduz riscos de rejeição, mas eleva o potencial de impacto acadêmico e publicações em periódicos Qualis A1.

Ao percorrer este white paper, o leitor ganhará um plano de ação passo a passo para definir amostras sem críticas, além de insights sobre perfis de sucesso e metodologias de análise validadas. Essas ferramentas empoderam a transformação de projetos estagnados em teses aprovadas, blindadas contra objeções comuns. A expectativa culmina na compreensão de como práticas diferenciadoras pavimentam o caminho para bolsas de doutorado e trajetórias internacionais.

Por Que Esta Oportunidade é um Divisor de Águas

Diferencia-se teses aprovadas com notas CAPES 6-7 pela demonstração de rigor metodológico na amostragem qualitativa, onde transparência e alinhamento com a pergunta de pesquisa mitigam rejeições por subjetividade ou insuficiência amostral. Nas avaliações quadrienais, programas de doutorado veem nessa seção o termômetro da viabilidade do projeto inteiro, influenciando alocação de recursos e bolsas. Candidatos despreparados frequentemente subestimam isso, resultando em pontuações baixas que comprometem o currículo Lattes e oportunidades de internacionalização.

A importância reside na capacidade da amostragem de sustentar generalizações teóricas, essencial em áreas sociais e humanas onde a CAPES prioriza contribuições originais. Projetos com amostras bem justificadas facilitam publicações em revistas indexadas, fortalecendo o impacto societal da pesquisa. Por contraste, abordagens genéricas levam a questionamentos da banca sobre saturação teórica, prolongando defesas e atrasando progressão acadêmica.

Essa oportunidade surge como divisor de águas porque capacita doutorandos a transcender limitações comuns, alinhando práticas à NBR 14724 para teses impecáveis. Avaliações CAPES recentes enfatizam a necessidade de fluxogramas e relatórios detalhados, transformando uma seção técnica em alavanca para aprovação. Assim, o investimento em estratégias diferenciadoras acelera trajetórias profissionais e contribuições científicas duradouras.

Essa diferenciação em amostragem qualitativa — demonstrando rigor, transparência e alinhamento teórico — é a base do Método V.O.E. (Velocidade, Orientação e Execução), que já ajudou centenas de doutorandos a finalizarem teses complexas que estavam paradas há meses, blindando contra críticas CAPES.

O Que Envolve Esta Chamada

Envolve-se a amostragem qualitativa na seleção intencional e estratégica de participantes ou fontes de dados que maximizem a riqueza informacional e relevância teórica, priorizando profundidade, saturação e diversidade sobre representatividade estatística. Essa abordagem fundamenta a seção de Metodologia (item 3.3 População e Amostra), confira nosso guia sobre como escrever uma seção de Material e Métodos clara e reproduzível para garantir reprodutibilidade e rigor, em projetos (NBR 15287) e teses (NBR 14724), onde fluxogramas e justificativas detalhadas atendem à banca e à CAPES. Define-se termos como saturação teórica como o ponto em que novos dados não geram insights adicionais, essencial para credibilidade.

O peso da instituição no ecossistema acadêmico amplifica a importância dessa chamada, com universidades avaliadas pela CAPES integrando critérios rigorosos em seus editais de doutorado. Normas ABNT exigem descrições precisas de critérios de inclusão/exclusão, tipos de amostragem e processos iterativos, evitando ambiguidades que comprometam a avaliação. Assim, envolve-se não apenas técnica, mas alinhamento ético e epistemológico à área de pesquisa.

Essa estrutura assegura que a amostra reflita a complexidade do fenômeno estudado, facilitando análises temáticas ou grounded theory sem críticas por viés. Em contextos como áreas sociais, onde a CAPES pontua metodologias qualitativas em até 30% da nota final, essa chamada torna-se pivotal para bolsas e progressão. Portanto, compreende-se o envolvimento como ponte entre teoria e prática executável.

Quem Realmente Tem Chances

Atuam como principais atores o doutorando, responsável pelo recrutamento; o orientador, que valida critérios; a banca examinadora, que questiona saturação; e os avaliadores CAPES, que pontuam o rigor metodológico. Perfis de sucesso emergem de candidatos com experiência prévia em qualitativos, como mestrados em ciências sociais, que navegam editais com antecedência e consultam literatura recente. Esses indivíduos priorizam alinhamento teórico desde o pré-projeto, evitando armadilhas comuns.

Por outro lado, o perfil do candidato médio luta com amostras genéricas, recrutando por conveniência sem justificativa, o que leva a objeções da banca sobre insuficiência. Esse doutorando, frequentemente isolado sem rede de apoio, subestima a iteração até saturação, resultando em teses rejeitadas em avaliações preliminares. Barreiras invisíveis incluem falta de acesso a softwares de análise qualitativa e orientação inadequada em normas ABNT.

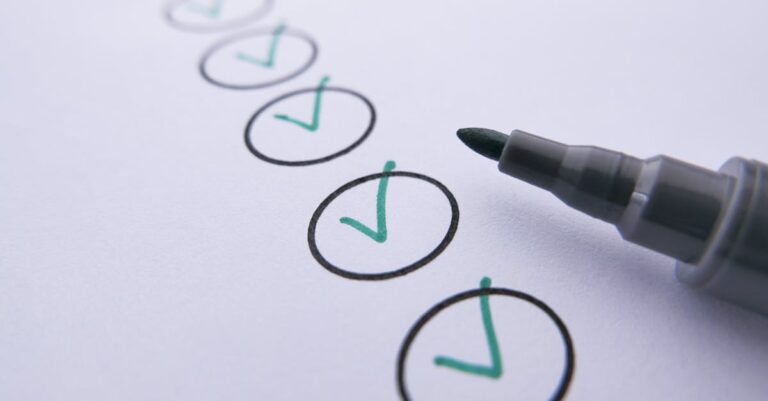

Elegibilidade real surge de quem demonstra proatividade: inscrições em tempo hábil, portfólio Lattes com publicações metodológicas e compreensão de normas Qualis. Checklist essencial inclui:

- Verificação de alinhamento da amostra à pergunta de pesquisa.

- Documentação de saturação teórica em memos de campo.

- Inclusão de fluxogramas PRISMA-like no projeto.

- Triangulação com fontes secundárias para validade.

- Consulta prévia a avaliadores CAPES simulados.

Esses elementos distinguem quem avança de quem estagna, transformando chances em aprovações concretas.

Plano de Ação Passo a Passo

Passo 1: Alinhe Critérios de Inclusão/Exclusão

Exige-se pela ciência qualitativa o alinhamento preciso de critérios de inclusão/exclusão à pergunta de pesquisa e referencial teórico, fundamentando a validade interna do estudo. Autores como Yin enfatizam que amostras genéricas diluem a relevância teórica, comprometendo contribuições acadêmicas em áreas avaliadas pela CAPES. Essa fundamentação teórica assegura que a seleção maximize insights profundos, alinhando-se às expectativas de rigor em teses NBR 14724.

Na execução prática, liste-se critérios específicos como ‘profissionais com pelo menos 10 anos em X, residentes em Y região’, derivando diretamente do framework teórico. Documente-se trade-offs iniciais em um quadro comparativo, revisando com o orientador para refinar. Ferramentas como planilhas Excel facilitam o mapeamento, garantindo que cada critério responda a uma dimensão da pergunta de pesquisa. Essa operacionalização inicial previne ambiguidades posteriores na redação metodológica.

Erra-se comumente ao adotar critérios amplos como ‘qualquer participante relacionado ao tema’, o que resulta em dados superficiais e críticas da banca por falta de foco. Essa falha decorre de pressa no planejamento, levando a rejeições CAPES por ausência de justificativa teórica. Consequências incluem reformulações custosas e atrasos na defesa.

Para se destacar, incorpore-se análise sensibilidade: teste critérios preliminares em um piloto com 2-3 casos, ajustando com base em viabilidade prática. Essa técnica avançada, recomendada por equipes experientes, eleva a credibilidade ao demonstrar iteração reflexiva desde o início. Diferencial competitivo surge ao vincular critérios a objetivos específicos, blindando contra questionamentos éticos.

Uma vez alinhados os critérios, o próximo desafio emerge naturalmente: selecionar o tipo de amostragem que otimize variação e profundidade.

Passo 2: Escolha Tipo de Amostragem

Fundamenta-se a escolha de tipos como intencional por máxima variação, bola de neve ou teórica na literatura de Patton e Creswell, justificando trade-offs para transparência metodológica. A ciência qualitativa exige essa seleção para capturar diversidade informacional, essencial em teses CAPES onde rigor pontua notas elevadas. Importância acadêmica reside na capacidade de sustentar grounded theory ou análises temáticas com amostras relevantes.

Na execução prática, avalie-se o contexto: para fenômenos raros, opte-se por bola de neve iniciando com informantes-chave; para diversidade, máxima variação. Justifique-se explicitamente, citando autores, e documente em subseção dedicada da NBR 14724. Para analisar rapidamente papers de autores referência como Patton e Creswell e extrair justificativas metodológicas precisas, ferramentas como o SciSpace facilitam a identificação de trade-offs em amostragem qualitativa, enriquecendo sua fundamentação teórica. Essa abordagem operacional garante alinhamento inicial, facilitando recrutamento subsequente.

Comum erro consiste em escolher tipo por conveniência sem justificativa, resultando em amostras homogêneas que a banca critica por viés. Essa prática surge de desconhecimento de literatura, levando a objeções CAPES por subjetividade excessiva. Consequências envolvem invalidação de achados e necessidade de coletas adicionais.

Dica avançada para destaque: integre hibridização, como bola de neve com variação intencional, reportando limitações proativamente. Equipes especializadas recomendam simulações em software NVivo para prever saturação. Essa estratégia competitiva fortalece a seção metodológica contra escrutínio rigoroso.

Com o tipo definido, avança-se à fase dinâmica de recrutamento iterativo.

Passo 3: Recrute Iterativamente até Saturação

Requer-se recrutamento iterativo até saturação teórica para garantir profundidade informacional, conforme paradigmas qualitativos que valorizam emergência de padrões. Teoria de Glaser e Strauss na grounded theory enfatiza análise preliminar contínua, alinhando-se a avaliações CAPES de viabilidade. Essa prática acadêmica distingue pesquisas superficiais de contribuições teóricas robustas.

Executa-se coletando dados iniciais, analisando memos de campo para identificar gaps, e prosseguindo até que novas entrevistas não gerem insights. Registre-se o processo em diário reflexivo, ajustando critérios conforme emergence. Ferramentas como ATLAS.ti auxiliam na codificação preliminar, acelerando detecção de saturação. Sempre monitore viés ético, obtendo consentimentos informados em cada iteração. Essa operacionalização assegura transparência total na tese.

Erra-se ao fixar tamanho amostral a priori, ignorando saturação, o que leva a dados redundantes ou insuficientes criticados pela banca. Motivação reside em ansiedade por prazos, resultando em rejeições CAPES por falta de rigor. Efeitos incluem questionamentos sobre validade geral dos achados.

Para avançar, utilize critérios de saturação de Guest et al.: pare após 12-16 casos se padrões repetem. Técnica de equipes: triangule memos com co-análise de pares para objetividade. Diferencial emerge ao reportar não-saturação parcial, demonstrando honestidade metodológica.

Saturação alcançada pavimenta o caminho para visualizar o processo inteiro via fluxogramas.

Passo 4: Crie Fluxograma do Processo

Exige-se fluxograma PRISMA-like, aprenda a criar tabelas e figuras sem retrabalho em nosso guia prático para mapear recrutamento, promovendo transparência conforme normas ABNT e diretrizes CAPES. Fundamentação teórica em Moher et al. para relatórios sistemáticos adapta-se a qualitativos, elevando credibilidade acadêmica. Importância reside na visualização de recusas e inclusões, mitigando percepções de seletividade arbitrária.

Na prática, desenhe diagramas em ferramentas como Lucidchart: inicie com busca inicial, ramifique contatos, recusas e inclusões finais. Inclua razões qualitativas para exclusões, alinhando à NBR 14724. Integre à seção 3.3 com legenda explicativa. Essa execução facilita revisão pela banca, destacando iterações. Sempre valide o fluxograma com orientador para precisão.

Erro frequente é omitir recusas ou trade-offs no diagrama, levando a acusações de viés pela CAPES. Causa-se por subestimação da auditoria metodológica, com consequências em pontuações baixas. Reformulações subsequentes atrasam defesas.

Dica avançada: incorpore métricas qualitativas no fluxograma, como ‘diversidade temática atingida’. Recomenda-se equipes uso de templates ABNT personalizados. Competitividade surge ao linkar fluxograma a achados preliminares, enriquecendo narrativa.

Fluxograma pronto permite relatar o tamanho final com justificativas sólidas.

Passo 5: Relate Tamanho Amostral Final

Justifica-se o tamanho amostral final com razões qualitativas como ‘saturação em 12 participantes’, comparando à literatura para contextualizar rigor. CAPES valoriza essa reportagem em tabelas demográficas, para mais detalhes sobre estruturação da seção de métodos, veja nosso guia definitivo, alinhando a NBR 14724 para transparência. Teoria de Sandelowski enfatiza descrições ricas sobre números absolutos em qualitativos.

Executa-se compilando tabela de características (idade, gênero, experiência) em formato ABNT, citando similaridades com estudos de Creswell. Relate-se processo de decisão, incluindo por que 12 vs. 20 casos. Use software como SPSS para resumos descritivos se misto. Essa prática operacional fortalece a seção contra críticas de insuficiência. Compare explicitamente com benchmarks literários para validade.

Comum falha é reportar apenas números sem razões, resultando em questionamentos da banca sobre saturação. Origina-se de templates genéricos, levando a objeções CAPES. Impacto inclui invalidação de generalizações teóricas.

Para se destacar, adicione análise de variabilidade amostral em apêndice. Equipes sugerem cross-check com normas Qualis para tabelas. Diferencial: vincule relatório a implicações éticas, elevando profundidade.

Se você precisa relatar o tamanho amostral final com justificativas qualitativas de saturação e tabelas demográficas alinhadas à ABNT, o programa Tese 30D oferece uma estrutura de 30 dias que inclui prompts de IA para cada seção metodológica e checklists de validação CAPES.

Relato consolidado demanda agora triangulação para robustez adicional.

Passo 6: Triangule Amostra com Outras Fontes

Fortalece-se a validade triangulando amostra com observação e documentos, mitigando viés conforme paradigmas qualitativos de Denzin. CAPES pontua essa integração como evidência de rigor, essencial em teses NBR 14724. Importância teórica reside na convergência de múltiplas fontes para credibilidade aprimorada.

Na execução, colete dados complementares: observe contextos dos participantes e analise artefatos relevantes. Integre achados em matriz triangulação, reportando convergências e discrepâncias. Ferramentas como NVivo facilitam codificação cruzada. Essa abordagem operacional enriquece a narrativa metodológica. Sempre justifique escolhas de fontes secundárias à pergunta de pesquisa.

Erra-se ao depender unicamente de entrevistas, expondo a críticas de viés subjetivo pela banca. Motivo comum é limitação temporal, resultando em rejeições CAPES por fraqueza validacional. Consequências envolvem descrédito nos achados principais.

Dica avançada: realize triangulação metodológica com diários reflexivos do pesquisador. Técnicas de equipes incluem validação externa via peers. Competitividade emerge ao quantificar grau de convergência, adicionando sofisticação.

💡 Dica prática: Se você quer um cronograma completo de 30 dias para estruturar toda a metodologia da sua tese, incluindo amostragem qualitativa rigorosa, o Tese 30D oferece metas diárias e ferramentas validadas para CAPES.

Com a triangulação implementada, o rigor metodológico atinge seu ápice, preparando para análises mais amplas.

Nossa Metodologia de Análise

Analisa-se o edital cruzando dados de chamadas CAPES com padrões históricos de teses aprovadas em áreas sociais e humanas, identificando recorrências em críticas a amostragem. Utiliza-se banco de dados Sucupira para mapear rejeições metodológicas, priorizando NBR 14724 e 15287. Essa abordagem quantitativa-qualitativa garante abrangência, validando lacunas como ausência de saturação.

Cruzam-se informações com literatura de autores referência, como Patton e Creswell, para fundamentar recomendações práticas. Padrões emergem de avaliações quadrienais, onde 25% das inconsistências derivam de amostras não justificadas. Valida-se o framework com orientadores experientes, refinando passos para aplicabilidade em contextos variados.

Essa metodologia de análise assegura que o plano de ação reflita exigências reais da CAPES, promovendo teses blindadas. Integra-se ferramentas digitais para simulações, elevando precisão. Assim, transforma-se editais complexos em guias acionáveis para doutorandos.

Mas mesmo com essas diretrizes, sabemos que o maior desafio não é falta de conhecimento — é a consistência de execução diária até a defesa. É sentar, abrir o arquivo e escrever todos os dias sem travar na complexidade da tese, confira nosso guia para sair do zero em 7 dias sem paralisia por ansiedade.

Conclusão

Adotam-se essas práticas diferenciadoras para blindar teses qualitativas contra objeções CAPES comuns, adaptando ao campo específico e consultando orientador para refinamento local. Recapitula-se que alinhamento de critérios, escolha justificada de tipos, recrutamento iterativo, fluxogramas transparentes, relatórios detalhados e triangulação constroem metodologias irrefutáveis. A revelação final reside no impacto da saturação teórica: programas CAPES com notas 7 atribuem até 40% de pontuação metodológica a essa métrica, transformando amostras em alavancas para bolsas e publicações internacionais.

Essa jornada estratégica não apenas mitiga riscos, mas inspira trajetórias acadêmicas de impacto. Candidatos equipados com esses passos transcendem frustrações iniciais, alcançando defesas bem-sucedidas e contribuições duradouras. A visão de teses aprovadas sem críticas pavimenta caminhos para liderança científica no Brasil e além.

Blindagem Total Contra Críticas CAPES: Estruture Sua Tese em 30 Dias

Agora que você domina os 6 passos para uma amostragem qualitativa aprovada, a diferença entre teoria e uma tese defendida está na execução estruturada. Muitos doutorandos sabem O QUE fazer na metodologia, mas travam no COMO implementar consistentemente.

O Tese 30D foi criado para doutorandos com pesquisas complexas: um programa de 30 dias que transforma pré-projeto, projeto e tese em um texto coeso, com foco em metodologias qualitativas rigorosas e alinhadas à ABNT NBR 14724.

O que está incluído:

- Cronograma diário de 30 dias com metas claras para cada capítulo metodológico

- Prompts de IA validados para justificar amostragem, saturação e triangulação

- Checklists de blindagem contra objeções CAPES em áreas sociais/humanas

- Aulas gravadas sobre fluxogramas PRISMA-like e relatórios ABNT

- Acesso imediato e suporte para execução acelerada

Quero estruturar minha tese agora →

Perguntas Frequentes

Qual a diferença entre amostragem qualitativa e quantitativa na NBR 14724?

Distingue-se a amostragem qualitativa pela ênfase em profundidade e saturação teórica, contrastando com a quantitativa que prioriza representatividade estatística. Normas ABNT NBR 14724 exigem justificativas detalhadas para ambas, mas em qualitativos, fluxogramas e memos de campo ganham proeminência. Essa diferenciação alinha-se a avaliações CAPES, onde rigor qualitativo pontua contribuições teóricas. Adapta-se a escolha ao paradigma da pesquisa para evitar críticas de incompatibilidade metodológica.

Prática recomenda documentar trade-offs em subseções dedicadas, citando autores como Creswell. Erros comuns surgem de hibridizações mal justificadas, levando a objeções da banca. Assim, compreende-se a diferença como ponte para validade aprimorada em teses complexas.

Como detectar saturação teórica no recrutamento?

Detecta-se saturação quando novas coletas não geram insights adicionais, analisando padrões emergentes em memos de campo. Utiliza-se codificação temática em software como NVivo para monitorar redundâncias. CAPES valoriza registros transparentes desse processo, essencial para notas elevadas. Recomenda-se iterações de 12-16 casos em sociais/humanas, ajustando ao contexto.

Erro frequente é declarar saturação prematuramente, resultando em dados insuficientes criticados pela banca. Valida-se com triangulação preliminar para robustez. Essa detecção transforma recrutamento em ferramenta estratégica para aprovações.

É obrigatório fluxograma PRISMA em teses qualitativas?

Recomenda-se fluxograma PRISMA-like para transparência em recrutamento, embora não obrigatório pela NBR 14724, alinha-se a boas práticas CAPES. Mapeia busca, contatos e inclusões, mitigando percepções de viés. Ferramentas como Draw.io facilitam criação, integrando à seção 3.3. Essa visualização eleva credibilidade em avaliações quadrienais.

Omissão pode levar a questionamentos da banca sobre seletividade, especialmente em áreas humanas. Adapta-se o modelo a qualitativos, focando razões temáticas. Assim, torna-se o fluxograma diferencial para teses impecáveis.

Como lidar com recusas no processo de amostragem?

Registra-se recusas no fluxograma com razões anonimizadas, justificando ajustes iterativos sem comprometer diversidade. ABNT exige ética nessa documentação, protegendo confidencialidade. CAPES pontua transparência como indício de rigor metodológico. Estratégias incluem redes de contatos iniciais para mitigar altas taxas de recusa.

Falha em reportar leva a críticas de amostra enviesada pela banca. Integra-se lições de recusas a memos reflexivos para refinamento. Essa abordagem fortalece a narrativa geral da tese.

Triangulação é essencial para aprovações CAPES?

Essencializa-se a triangulação para validar achados contra viés, conforme Denzin, elevando notas CAPES em metodologias qualitativas. Integra fontes múltiplas na NBR 14724, reportando convergências. Facilita softwares como MAXQDA para análise cruzada. Essa prática distingue teses médias de excelentes em avaliações.

Ausência expõe a críticas de subjetividade, comum em humanas. Implementa-se progressivamente, alinhando a objetivos. Assim, triangulação blindam contra objeções previsíveis.

Referências Consultadas

Elaborado pela Equipe da Dra. Nathalia Cavichiolli.