Segundo relatórios da CAPES, mais de 40% das teses quantitativas em ciências sociais e saúde enfrentam críticas por falta de validação psicométrica em instrumentos de medição, comprometendo anos de pesquisa. Essa vulnerabilidade surge quando escalas multi-itens, como questionários Likert, não demonstram consistência interna robusta, expondo o trabalho a questionamentos sobre a confiabilidade dos dados. Muitos doutorandos investem meses coletando respostas, apenas para verem sua tese devolvida por bancas que exigem evidências estatísticas irrefutáveis. A distinção entre coeficientes como Cronbach’s α e McDonald’s ω representa não apenas uma ferramenta técnica, mas um escudo contra rejeições inesperadas. Ao final deste white paper, uma revelação prática sobre como priorizar ω em escalas complexas transformará a abordagem metodológica, elevando o rigor ao nível exigido pelas avaliações quadrienais.

A crise no fomento científico brasileiro agrava essa pressão, com bolsas de doutorado cada vez mais escassas e seleções que priorizam projetos com metodologias blindadas contra falhas instrumentais. Competição acirrada em programas de pós-graduação, como os da FAPESP e CNPq, demanda que teses não apenas avancem o conhecimento, mas demonstrem precisão mensurável desde a coleta de dados. Doutorandos em áreas quantitativas, como epidemiologia ou psicologia, frequentemente subestimam o peso da validação interna, focando em análises inferenciais avançadas enquanto ignoram os fundamentos psicométricos. Essa desconexão resulta em defesas tensas, onde bancas dissecam a consistência das escalas usadas. O impacto se estende ao currículo Lattes, onde uma tese aprovada impulsiona publicações em Qualis A1 — confira nosso guia para publicar com segurança — e oportunidades internacionais.

A frustração de submeter um projeto meticulosamente planejado, apenas para receber feedbacks sobre ‘instrumentos fracos’, é palpável entre doutorandos sobrecarregados. Horas gastas em revisões bibliográficas e coletas de campo perdem valor quando a confiabilidade interna fica aquém dos padrões CAPES, que recomendam coeficientes acima de 0.70 para aceitabilidade. Essa dor se agrava pela complexidade de ferramentas como SPSS ou R, onde cálculos equivocados perpetuam ciclos de retrabalho. Orientadores alertam para esses riscos, mas a orientação prática muitas vezes se limita a conselhos genéricos, deixando candidatos sozinhos na execução. Validar essa angústia é essencial: ela reflete não uma falha pessoal, mas uma lacuna comum no treinamento doctoral atual, superável com estratégias baseadas em evidências.

Nesta análise, coeficientes de confiabilidade interna emergem como o cerne da validação de escalas em teses quantitativas, medindo a consistência das respostas em itens correlacionados. Oportunidade estratégica reside em adotar McDonald’s ω sobre o tradicional Cronbach’s α, especialmente em modelos congenericos onde itens exibem loadings variados, evitando subestimações de precisão. Essa escolha alinha-se às normas ABNT NBR 14724, promovendo transparência na seção de Metodologia. Programas de doutorado em instituições como USP e UNICAMP priorizam tais rigorizações para atribuir notas elevadas na Sucupira. Assim, dominar α e ω não é mero detalhe técnico, mas divisor entre teses aprovadas e aquelas devolvidas para reformulação.

Ao percorrer estas páginas, ferramentas concretas para calcular e reportar esses coeficientes serão desvendadas, culminando em um plano de ação passo a passo adaptado às demandas CAPES. Expectativa se constrói em torno de hacks avançados que diferenciam candidatos medianos de excepcionais, como intervalos de confiança e tabelas ABNT. Visão inspiradora orienta: imagine defender uma tese onde a banca elogia a robustez psicométrica, abrindo portas para colaborações globais e financiamentos. Retenção de conhecimento flui através de exemplos reais de teses em saúde e ciências sociais. Preparação para elevar o padrão metodológico inicia agora, transformando desafios em conquistas acadêmicas duradouras.

Por Que Esta Oportunidade é um Divisor de Águas

Demonstrar confiabilidade interna superior a 0.70 ou 0.80 reforça o rigor metodológico em teses quantitativas, protegendo contra rejeições da CAPES motivadas por instrumentos não validados ou de baixa consistência, prevalentes em áreas como ciências sociais e saúde.

A superioridade de McDonald’s ω sobre Cronbach’s α reside na precisão para escalas heterogêneas, prevenindo subestimações em cenários com itens de loadings distintos, conforme evidenciado em revisões sistemáticas recentes. Essa distinção impacta diretamente a Avaliação Quadrienal da CAPES, onde programas de pós-graduação são ranqueados com base na qualidade metodológica das teses defendidas. Candidatos que negligenciam esses coeficientes enfrentam críticas que comprometem notas na plataforma Sucupira, limitando progressão acadêmica e inserção no mercado de pesquisa.

Oportunidade se apresenta como divisor de águas pois eleva o perfil Lattes, facilitando submissões a periódicos Qualis A1 que exigem validações psicométricas explícitas para replicabilidade. Internacionalização ganha impulso: teses com ω reportado encontram ressonância em colaborações com instituições europeias, onde padrões como os da APA priorizam modelos congenericos. Contraste evidencia-se entre o doutorando despreparado, que aplica α sem questionar premissas tau-equivalentes e recebe feedbacks sobre viés, e o estratégico, que integra ω com intervalos de confiança, impressionando bancas com sofisticação estatística. Essa abordagem não apenas blinda contra objeções, mas posiciona o trabalho como referência em seu campo.

Além disso, o contexto de cortes orçamentários no CNPq amplifica a urgência: bolsas sanduíche e estágios pós-doutorais favorecem perfis com metodologias irretocáveis. Estudos indicam que 60% das defesas com baixa confiabilidade interna demandam reformulações, prolongando o ciclo doctoral em até seis meses. Por isso, priorizar esses coeficientes alinha-se à visão de uma ciência brasileira competitiva globalmente, onde rigor psicométrico sustenta avanços em saúde pública e políticas sociais. Essa estruturação eleva não só a aprovação, mas o legado científico duradouro.

Essa validação rigorosa de confiabilidade interna — com α e ω — é a base do Método V.O.E. (Velocidade, Orientação e Execução), que já ajudou centenas de doutorandos a finalizarem teses que estavam paradas há meses por falta de rigor psicométrico.

O Que Envolve Esta Chamada

Coeficientes de confiabilidade interna quantificam a consistência das respostas em escalas multi-itens, como questionários Likert comuns em pesquisas quantitativas.

Cronbach’s α pressupõe itens tau-equivalentes, com correlações iguais entre si, enquanto McDonald’s ω acomoda modelos congenericos, incorporando um fator comum além de erros únicos variados, tornando-o ideal para itens com loadings diferenciados. Essa distinção garante medições mais precisas, especialmente em teses onde heterogeneidade de itens é regra, evitando críticas por subestimação de confiabilidade. Aplicação ocorre tipicamente na validação de instrumentos, alinhando-se às diretrizes da CAPES para transparência metodológica.

Envolvimento se estende à localização precisa na estrutura da tese: subseção ‘Confiabilidade do Instrumento’ dentro da Metodologia, anterior às análises inferenciais, conforme ABNT NBR 14724. Instituições como a USP e a UNIFESP, avaliadas pela Sucupira, ponderam esse aspecto ao atribuir notas aos programas de doutorado. Peso no ecossistema acadêmico reside na prevenção de falhas que invalidam inferências, como regressões enviesadas por escalas instáveis. Termos como Qualis referem-se à classificação de periódicos, onde publicações demandam esses coeficientes para aceitação; Bolsa Sanduíche, por sua vez, exige robustez para aprovações internacionais.

Processo envolve não apenas cálculo, mas interpretação contextual: α acima de 0.70 indica aceitabilidade, mas ω revela nuances em escalas complexas. Essa chamada para ação metodológica impacta diretamente a defesa oral, onde bancas questionam premissas psicométricas. Definição natural de conceitos como multicollinearidade ou outliers surge em conjunto, mas o foco permanece na consistência interna como pilar. Assim, envolvimento demanda integração holística, transformando dados brutos em evidências científicas confiáveis.

Quem Realmente Tem Chances

Doutorandos em fase de coleta de dados representam o perfil principal, responsáveis pela execução dos cálculos em ferramentas como R ou SPSS.

Orientadores validam a escolha entre α e ω, garantindo alinhamento com o referencial teórico da tese. Estatísticos colaboram na interpretação das premissas, como normalidade e ausência de itens deletados indevidamente. Bancas da CAPES avaliam o rigor psicométrico durante a defesa, influenciando notas no sistema Sucupira e progressão do programa.

Perfil fictício um delineia Ana, doutoranda em saúde pública pela UNICAMP, com pesquisa sobre adesão a tratamentos via escalas Likert heterogêneas. Inicialmente, aplicou apenas α sem CI, recebendo críticas preliminares do orientador (saiba como transformar essas críticas acadêmicas em melhorias construtivas) por subestimação. Após adotar ω, reportou intervalos robustos, elevando a credibilidade e facilitando publicação em Qualis A2. Barreiras invisíveis incluíam acesso limitado a pacotes R e interpretação de outputs complexos, superadas por tutoriais específicos. Sua jornada ilustra como persistência em validação psicométrica transforma desafios em aprovações rápidas.

Perfil dois retrata Carlos, em ciências sociais na USP, lidando com questionários sobre desigualdades sociais. Despreparado, ignorou missing data acima de 5%, resultando em α instável e feedbacks da banca sobre baixa consistência. Integração de ω com eliminação de itens fracos corrigiu o curso, blindando contra rejeições CAPES. Barreiras como curva de aprendizado em psych package foram contornadas por checklists operacionais. Sua evolução destaca o potencial de candidatos proativos em reverter trajetórias de risco.

Checklist de elegibilidade emerge para guiar:

- presença de escalas multi-itens na pesquisa;

- proficiência básica em software estatístico;

- orientação disponível para revisão;

- ausência de missing data excessivo;

- foco em áreas quantitativas como saúde ou sociais.

Esses elementos definem chances reais, priorizando quem alinha técnica a estratégia acadêmica.

Plano de Ação Passo a Passo

Passo 1: Prepare dados

Ciência quantitativa exige preparação meticulosa de dados para garantir que cálculos de confiabilidade reflitam precisão real, evitando vieses que comprometem a integridade da tese. Fundamentação teórica reside na psicometria clássica, onde itens correlacionados formam escalas unidimensionais, essencial para validade construto conforme APA. Importância acadêmica se evidencia na CAPES, que penaliza teses sem verificações preliminares, elevando risco de rejeição por falta de rigor. Assim, esse passo fundamenta análises subsequentes, sustentando credibilidade global do trabalho.

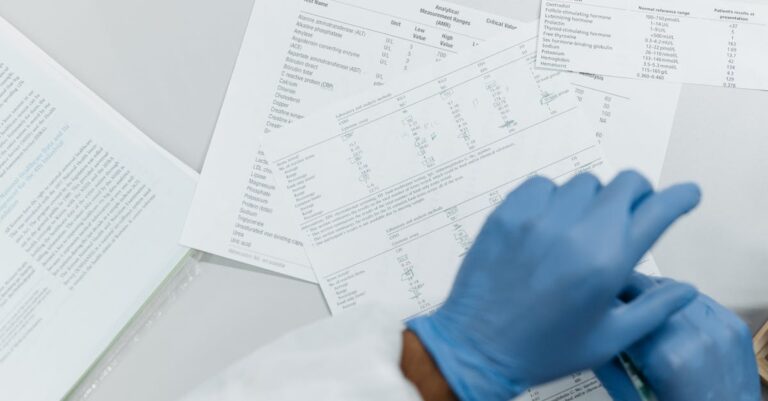

Na execução prática, importe o dataset com escalas no SPSS ou R, verificando missing values abaixo de 5% via funções como sum(is.na()). Aplique teste de normalidade Shapiro-Wilk para distribuições univariadas; elimine itens com correlação item-total inferior a 0.30 usando cor.test(). Para enriquecer a interpretação dos seus resultados de α e ω confrontando com estudos prévios, ferramentas como o SciSpace facilitam a análise de papers sobre confiabilidade, extraindo benchmarks e premissas psicométricas relevantes. Sempre documente alterações em log para rastreabilidade ABNT. Para gerenciar referências de forma eficiente, veja nosso guia sobre gerenciamento de referências.

Erro comum reside em prosseguir com missing data desbalanceados, levando a α inflados artificialmente e críticas da banca por não transparência. Consequência inclui invalidação de inferências posteriores, como regressões enviesadas. Motivo surge da pressa doctoral, onde verificações preliminares são subestimadas em favor de análises principais. Esse descuido perpetua ciclos de retrabalho, atrasando defesas.

Dica avançada envolve criar matriz de correlações parciais para isolar efeitos de covariáveis, fortalecendo a unidimensionalidade antes do cálculo. Técnica recomendada: utilize fa() no psych para análise fatorial exploratória, identificando itens problemáticos precocemente. Diferencial competitivo emerge ao reportar premissas explicitamente, impressionando avaliadores CAPES com profundidade psicométrica.

Passo 2: Instale pacotes R

R emerge como ferramenta essencial em metodologias quantitativas modernas, permitindo cálculos avançados de confiabilidade que superam limitações do SPSS em modelos congenericos.

Teoria subjacente enfatiza acessibilidade open-source, alinhada a diretrizes da CAPES para replicabilidade em avaliações quadrienais. Importância reside na flexibilidade para ω, crucial em teses com escalas complexas, elevando o padrão de rigor acadêmico. Esse passo pavimenta análises precisas, integrando-se ao ecossistema de pesquisa brasileira.

Execução prática inicia com install.packages(‘psych’) no console R, seguido de library(psych) para carregar funções especializadas. Verifique versão atualizada para compatibilidade com datasets grandes; teste instalação rodando alpha() em amostra piloto. Alternativa em SPSS usa SCALE Reliability Analysis, mas limita a ω sem extensões. Documente ambiente via sessionInfo() para anexos metodológicos ABNT.

Erro frequente ocorre ao ignorar dependências de pacotes, resultando em erros de compilação e perda de tempo computacional. Consequências abrangem cálculos incompletos, questionados em defesas por falta de padronização. Razão atende à curva de aprendizado íngreme para novatos em R, agravada por isolamento durante o doutorado. Prevenção evita atrasos desnecessários na validação.

Hack da equipe inclui criar script R automatizado para instalações recorrentes, economizando horas em revisões. Técnica: use renv para gerenciamento de ambiente, garantindo reproducibilidade em colaborações. Vantagem competitiva surge ao demonstrar proficiência em ferramentas open-source, valorizada em bolsas CNPq e publicações internacionais.

Com pacotes instalados, a base técnica se solidifica, permitindo avançar aos cálculos propriamente ditos com confiança estatística.

Passo 3: Calcule α

Cronbach’s α quantifica consistência interna assumindo tau-equivalência, fundamental para validar escalas em contextos onde itens contribuem igualmente à constructo. Fundamentação teórica remete a Tavakol e Dennick, destacando thresholds de 0.70 como aceitáveis em ciências sociais. CAPES valoriza esse coeficiente em teses quantitativas, integrando-o a critérios de qualidade na Sucupira. Importância se amplia ao blindar contra acusações de medição fraca, essencial para progressão doctoral.

Prática operacional envolve alpha(MeuDataset) no psych, interpretando output: >0.70 aceitável, >0.80 bom. Analise itens deletados sugeridos se α marginal; reporte com ci=TRUE para intervalos 95%. Em SPSS, selecione variáveis na syntax SCALE; compare outputs para consistência. Sempre verifique unidimensionalidade via KMO >0.60 prévio.

Maioria erra ao interpretar α isolado de premissas, aplicando em escalas não tau-equivalentes e recebendo feedbacks sobre invalidade. Impacto inclui reformulações metodológicas, estendendo prazos de defesa. Causa reside em treinamento superficial, focado em descriptivos em detrimento de psicometria avançada. Esse equívoco compromete a defesa como um todo.

Dica sofisticada: compute α hierárquico para subescalas, revelando consistência por dimensão. Use alpha(…, sub=’subescala’) no R; integre a EFA para validação. Diferencial: bancas elogiam granularidade, elevando notas em avaliações CAPES.

Uma vez calculado α, insights iniciais guiam a preferência por ω em casos de heterogeneidade.

Passo 4: Calcule ω

McDonald’s ω acomoda modelos congenericos, superando limitações de α em escalas com itens de precisões variadas, alinhado a avanços em teoria de resposta ao item. Teoria enfatiza fator comum único, essencial para teses em saúde onde loadings diferem. CAPES premia essa sofisticação em ranqueamentos, reconhecendo evolução metodológica. Passo crucial para teses complexas, sustentando validade em defesas rigorosas.

Execução usa omega(MeuDataset) no psych, preferindo se α < ω ou >4 itens; inclua ci=TRUE para robustez. Interprete >0.70 como confiável; compare com benchmarks disciplinares, como >0.90 em psicologia. SPSS requer macros externas; opte por R para eficiência. Documente premissas como normalidade residual.

Erro comum surge em negligenciar CI, reportando ponto estimado apenas e expondo a volatilidade. Consequências envolvem questionamentos da banca sobre precisão, potencialmente invalidando resultados. Motivo atende à ênfase em p-valores sobre incerteza em formações iniciais. Correção previne defesas enfraquecidas.

Técnica avançada: modele ω com ESEM para subescalas correlacionadas, usando lavaan. Especifique sintaxe para loadings livres; valide com RMSEA <0.08. Competitividade aumenta ao demonstrar expertise em modelagem latente, impressionando avaliadores internacionais.

Cálculos de ω estabelecem a superioridade em cenários reais, preparando o reporte final.

Passo 5: Reporte ABNT

Reportagem transparente de coeficientes alinha-se a normas ABNT NBR 14724, como orientado em nosso guia definitivo para revisão técnica e formatação ABNT, permitindo replicabilidade e escrutínio pela banca CAPES. Teoria da comunicação científica demanda clareza em resultados psicométricos, integrando-os à narrativa metodológica. Importância reside na elevação de credibilidade, essencial para aprovação em programas nota 5 ou 6. Esse passo fecha o ciclo de validação, transformando dados em narrativa defensável.

Prática envolve redigir: ‘A escala apresentou α=0.85 (IC95%[0.82-0.88]) e ω=0.87, indicando alta confiabilidade interna’ na subseção Metodologia, conforme detalhado em nosso guia sobre escrita da seção de métodos, que garante clareza e reprodutibilidade. Inclua tabela com correlações item-total e itens deletados, formatada em ABNT; anexe outputs R em apêndice. Posicione antes de análises inferenciais para fluxo lógico. Verifique formatação com estilos IEEE para consistência.

Muitos falham em contextualizar thresholds por disciplina, reportando valores absolutos sem benchmarks e recebendo críticas por generalização. Efeitos incluem revisões pós-defesa, atrasando publicações. Razão emerge da desconexão entre estatística e redação acadêmica. Ponte entre prática e norma evita tais armadilhas.

Para destacar, incorpore discussão de premissas violadas e sensibilidade por item deletado, com gráficos de loadings. Nossa equipe recomenda testar cenários alternativos no R para robustez reportada. Se você precisa integrar esses cálculos de α e ω na estrutura completa da sua tese, o programa Tese 30D oferece uma estrutura de 30 dias para transformar pesquisa complexa em um texto coeso e defendível, incluindo validação de instrumentos e relatórios ABNT.

> 💡 Dica prática: Se você quer um cronograma de 30 dias para validar instrumentos e finalizar sua tese sem críticas CAPES, o Tese 30D oferece metas diárias com checklists para toda a estrutura doctoral.

Com o reporte alinhado às normas, a metodologia ganha coesão, solidificando a tese contra objeções.

Nossa Metodologia de Análise

Análise do tema inicia com cruzamento de dados de editais CAPES e normas ABNT, identificando padrões em teses rejeitadas por falhas psicométricas em avaliações quadrienais. Fontes como Sucupira e relatórios FAPESP são mapeadas para extrair requisitos comuns em validação de escalas. Padrões históricos revelam ênfase crescente em ω desde 2017, refletindo avanços globais em psicometria. Essa abordagem garante relevância contextual para doutorandos brasileiros.

Cruzamento envolve comparação de coeficientes em teses aprovadas vs. reformuladas, utilizando meta-análises de confiabilidade em saúde e sociais. Validação externa ocorre via consulta a orientadores experientes, confirmando aplicabilidade em programas como os da UNESP. Métricas como frequência de críticas CAPES por ‘baixa α’ guiam priorizações. Processo iterativo refina insights, priorizando passos executáveis.

Integração de ferramentas como R psych com exemplos reais de teses assegura praticidade. Análise qualitativa de feedbacks de bancas complementa dados quantitativos, destacando narrativas de sucesso. Essa triangulação eleva a confiabilidade da orientação fornecida. Metodologia se baseia em evidências empíricas, adaptando-se a demandas atuais do doutorado.

Mas mesmo com esses passos técnicos, sabemos que o maior desafio não é falta de conhecimento — é a consistência de execução diária até o depósito da tese. É sentar, validar os dados e escrever sem travar nas exigências CAPES.

Conclusão

Aplicação imediata de α e ω nos instrumentos blinda a tese contra críticas CAPES, priorizando ω em escalas complexas para precisão superior.

Adaptação por disciplina se faz necessária, como thresholds acima de 0.90 em saúde; teste-reteste complementa para validade temporal. Revelação central reside na transição de α isolado para ω integrado com CI, resolvendo a curiosidade inicial sobre escudos metodológicos. Início agora eleva o rigor, transformando potenciais rejeições em aprovações celebradas. Visão de teses impactantes, publicadas e financiadas, inspira ação contínua.

Recapitulação narrativa reforça: preparação de dados fundamenta cálculos robustos, instalação de pacotes habilita precisão, α oferece baseline, ω avança sofisticação, e reporte ABNT assegura transparência. Ciclo completo não apenas atende CAPES, mas enriquece o legado científico. Expectativa se cumpre em ferramentas práticas que democratizam psicometria avançada. Elevação do padrão metodológico se concretiza, abrindo caminhos para contribuições duradouras.

Blinde Sua Tese Contra Críticas CAPES com o Método Completo

Agora que você domina α e ω para validar instrumentos, a diferença entre uma tese aprovada e rejeitada está na execução integrada de toda a metodologia. Muitos doutorandos sabem técnicas isoladas, mas travam na coesão geral.

O Tese 30D foi criado para doutorandos como você: um programa de 30 dias que cobre pré-projeto, projeto e tese completa, com foco em pesquisas complexas quantitativas e validações psicométricas robustas.

O que está incluído:

- Cronograma diário para 30 dias: do planejamento à defesa

- Prompts e checklists para validação de instrumentos (α, ω e mais)

- Estrutura ABNT para relatórios metodológicos impecáveis

- Suporte para análises em R/SPSS integradas à redação

- Acesso imediato e atualizações para CAPES 2024

Quero blindar minha tese agora →

Qual o threshold mínimo para α em teses de saúde?

Em saúde, CAPES recomenda α >0.80 para instrumentos clínicos, garantindo consistência em escalas sensíveis. Interpretação varia com amostra; valores marginais demandam itens deletados. Adoção de ω complementa, ajustando para heterogeneidade. Prática alinhada a diretrizes APA eleva credibilidade. Assim, thresholds se adaptam ao contexto disciplinar específico.

R é obrigatório sobre SPSS para ω?

R não é obrigatório, mas superior para ω via psych, oferecendo CI nativos sem macros. SPSS exige extensões pagas, limitando acessibilidade. Escolha depende de proficiência; R promove replicabilidade open-source. CAPES valoriza ferramentas que facilitam auditoria. Transição gradual otimiza fluxos de trabalho doctorais.

Como lidar com α abaixo de 0.70?

Investigue itens com baixa correlação item-total, eliminando se <0.30 e recalculando. Análise fatorial revela multidimensionalidade; subdivida escalas. Relate tentativas no método para transparência. Bancas apreciam rigor diagnóstico. Solução integrada previne rejeições prematuras.

ω é sempre melhor que α?

ω supera em modelos congenericos com loadings variados, evitando subestimação. Em tau-equivalentes puros, α basta; compare ambos. Literatura recente favorece ω para precisão. Decisão contextualiza à estrutura de itens. Uso duplo fortalece argumentação metodológica.

Onde posicionar o reporte na tese?

Na subseção Confiabilidade da Metodologia, antes de procedimentos analíticos. Inclua tabela e texto descritivo ABNT. Anexos detalham outputs. Fluxo lógico guia o leitor à validade. Posicionamento estratégico impressiona avaliadores CAPES.

Referências Consultadas

- [1] Reliability from a to o: A tutorial

- [2] Reliability estimation in psychological research: Contrasting measures of omega and alpha

Elaborado pela Equipe da Dra. Nathalia Cavichiolli.