Segundo relatórios da CAPES, mais de 60% das teses e dissertações enfrentam questionamentos sobre a reprodutibilidade dos dados durante defesas, revelando uma falha sistêmica na organização inicial que compromete anos de pesquisa. Essa estatística alarmante destaca como a desorganização não é mero detalhe administrativo, mas barreira fundamental para a aprovação acadêmica.

Ao final deste white paper, uma revelação prática sobre como um checklist simples pode elevar a credibilidade de qualquer projeto será desvendada, transformando potenciais rejeições em aprovações unânimes.

O fomento científico no Brasil atravessa uma crise de recursos escassos, com editais do CNPq e CAPES cada vez mais competitivos, priorizando projetos que demonstrem rigor metodológico irrefutável. Revistas Qualis A exigem transparência total nos métodos de dados, sob pena de rejeição sumária. Candidatos, muitas vezes sobrecarregados por múltiplas demandas, veem suas submissões devolvidas por falhas que poderiam ser evitadas com práticas padronizadas desde o início.

A frustração de investir meses coletando dados apenas para ouvir da banca que a verificação independente é impossível ressoa em laboratórios e departamentos por todo o país. Pesquisadores relatam noites insones revisando arquivos caóticos, questionando se o esforço valerá a pena. Essa dor é real e compartilhada, agravada pela pressão de prazos apertados e expectativas elevadas dos orientadores.

Esta chamada para organização de dados surge como solução estratégica, delineando um processo sistemático que documenta, armazena e versiona informações de forma a garantir reprodutibilidade total. Editais recentes enfatizam metadados detalhados e convenções FAIR, tornando essa habilidade indispensável para bolsas e publicações. Adotar esse checklist não apenas atende normas, mas fortalece a integridade científica do trabalho.

Ao prosseguir, o leitor obterá um plano passo a passo para implementar essa organização, perfis de candidatos bem-sucedidos e insights sobre análise de editais. Essas seções equiparão com ferramentas para superar barreiras comuns, culminando em uma visão inspiradora de como dados bem gerenciados pavimentam caminhos para contribuições duradouras na ciência.

Por Que Esta Oportunidade é um Divisor de Águas

A reprodutibilidade total emerge como exigência imperiosa em editais da CAPES, CNPq e revistas Qualis A, pois sustenta a credibilidade científica fundamental. Sem ela, conclusões perdem validade, pois não podem ser verificadas independentemente, o que bancas consideram falha metodológica grave. Avaliações quadrienais da CAPES penalizam programas com baixa taxa de reprodutibilidade, impactando alocações de bolsas e recursos futuros. Projetos desorganizados não só arriscam rejeição imediata, mas também mancham o currículo Lattes, limitando oportunidades de internacionalização como bolsas sanduíche.

Contraste-se o candidato despreparado, que acumula arquivos em pastas genéricas sem versionamento, com o estratégico, que adota estruturas lógicas desde a coleta. O primeiro enfrenta questionamentos intermináveis na defesa, desperdiçando tempo valioso; o segundo impressiona avaliadores com transparência que acelera aprovações. Essa diferença determina não apenas o sucesso imediato, mas a trajetória de publicações em periódicos de alto impacto.

A organização de dados alinha-se à agenda global de ciência aberta, promovida por agências como a NSF e ERC, que priorizam projetos FAIR. No Brasil, a Plataforma Sucupira monitora indicadores de reprodutibilidade, influenciando rankings de programas de pós-graduação. Ignorar essa prática equivale a navegar sem bússola em águas competitivas, onde apenas os preparados emergem vitoriosos.

Essa estruturação rigorosa da metodologia é a base da nossa abordagem de escrita científica baseada em prompts validados, que já ajudou centenas de mestrandos e doutorandos a finalizarem dissertações e teses com reprodutibilidade total aprovada por bancas exigentes.

Imagine submeter um projeto onde cada dado é rastreável, elevando a confiança da banca e abrindo portas para colaborações internacionais. Essa oportunidade divide águas entre o comum e o excepcional na pesquisa acadêmica.

O Que Envolve Esta Chamada

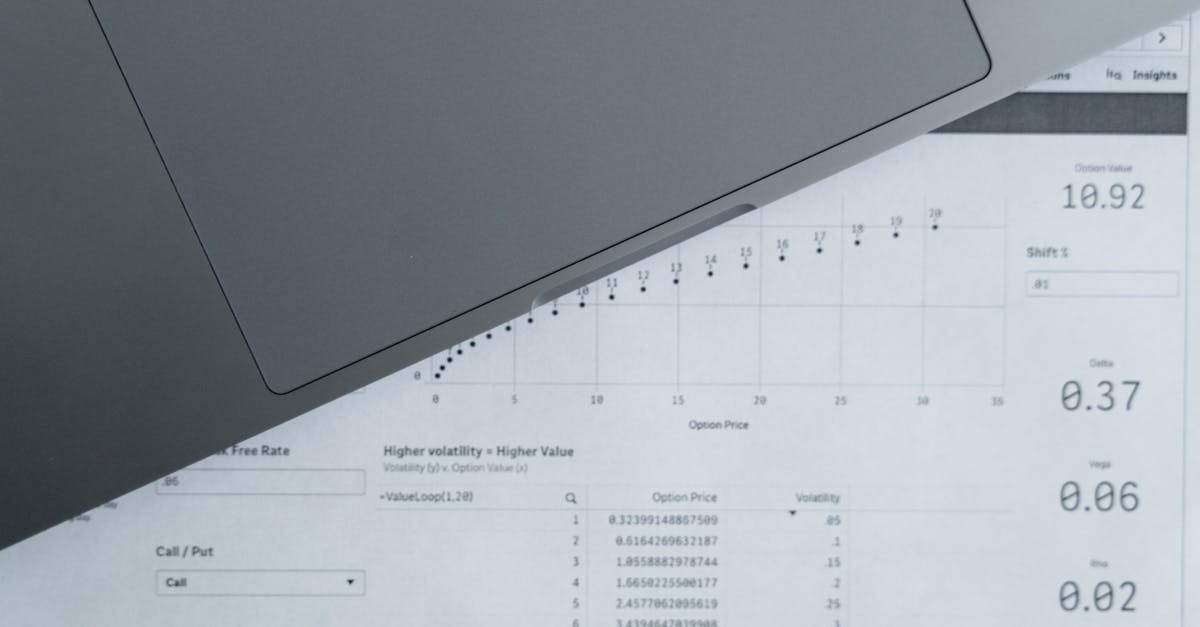

A organização de dados de pesquisa constitui o processo sistemático de documentar, armazenar, versionar e disponibilizar dados brutos, processados e scripts de análise, garantindo que pesquisadores independentes reproduzam resultados idênticos. Metadados detalhados acompanham cada etapa, incluindo origem, formato e transformações aplicadas, enquanto convenções de nomenclatura padronizadas evitam ambiguidades. Arquitetura de pastas lógicas separa insumos de outputs, facilitando auditorias metodológicas.

Essa prática aplica-se obrigatoriamente em todas as fases da pesquisa: da coleta em laboratórios ou campos, passando por processamento estatístico e análises intermediárias, até a produção de figuras, tabelas e arquivamento final. Normas universitárias e agências de fomento demandam repositórios institucionais ou abertos, como o Institucional da USP ou Zenodo, para preservação de longo prazo. Falhas nessa organização comprometem a ética científica, pois impedem verificação e reutilização.

Instituições como a Unicamp e a UFRJ integram pesos significativos no ecossistema nacional, com editais que avaliam reprodutibilidade como critério de desempate em seleções de mestrado e doutorado. Termos como Qualis referem-se à classificação de periódicos pela CAPES, enquanto Sucupira é o sistema de avaliação de pós-graduações que rastreia indicadores de qualidade. Bolsa Sanduíche, por sua vez, exige relatórios com dados reproduzíveis para mobilidade internacional.

Adotar essa chamada envolve compromisso contínuo, mas recompensa com credibilidade inabalável perante bancas e editores. A ênfase em transparência alinha projetos a padrões globais, preparando para avanços em campos interdisciplinares.

Quem Realmente Tem Chances

O principal responsável pela organização de dados reside no pesquisador mestrando ou doutorando, sob supervisão do orientador para validação de protocolos. Colaboradores incluem técnicos de laboratório na coleta, estatísticos na análise e bibliotecários especializados em repositórios. A banca examinadora atua como avaliadora final, verificando a reprodutibilidade durante defesas.

Considere o perfil de Ana, mestranda em Biologia Molecular: com dados de sequenciamento genômico acumulados em planilhas dispersas, ela enfrentou atrasos na análise por falta de versionamento.

Após adotar o checklist, sua tese foi aprovada sem ressalvas, destacando-se pela clareza metodológica que impressionou a banca.

Em contraste, João, doutorando em Economia, ignorou metadados em séries temporais, resultando em questionamentos sobre integridade durante a qualificação. Orientado a reestruturar, ele transformou caos em sistema FAIR, garantindo publicação em revista Qualis A e bolsa CNPq. Seu caso ilustra como persistência aliada a práticas padronizadas supera barreiras iniciais.

Barreiras invisíveis incluem sobrecarga curricular, falta de treinamento em ferramentas digitais e resistência cultural a documentação excessiva.

Checklist de elegibilidade:

- Experiência prévia em coleta de dados quantitativos ou qualitativos.

- Acesso a software de análise como R ou Python.

- Orientador engajado em ciência aberta.

- Disponibilidade para backups regulares.

- Conhecimento básico de princípios FAIR.

Esses elementos distinguem candidatos com chances reais de sucesso em ambientes competitivos.

Plano de Ação Passo a Passo

Passo 1: Crie estrutura de pastas por data e versão

A ciência exige versionamento rigoroso para rastrear evoluções nos dados, evitando perda de histórico que compromete a validade retrospectiva. Fundamentado em princípios de gerenciamento de projetos ágeis adaptados à pesquisa, esse passo previne sobreposições e facilita colaborações. Sua importância acadêmica reside na capacidade de demonstrar evolução metodológica perante avaliadores, elevando a confiança nos resultados finais.

Na execução prática, utilize formato AAAAMMDD_descrição_vX, como 20241215_entrevistas_qualitativas_v2, criando pastas hierárquicas no disco local ou nuvem. Inicie com uma pasta raiz para o projeto inteiro, subdividindo por fases: coleta, processamento e análise. Ferramentas como Git para versionamento de pastas ou simplesmente renomeação manual garantem rastreabilidade sem complexidade excessiva.

Um erro comum surge ao ignorar datas, levando a confusão entre versões e retrabalho desnecessário na defesa. Consequências incluem perda de credibilidade, com bancas questionando a integridade temporal dos dados. Esse equívoco ocorre por pressa inicial, subestimando o impacto futuro na verificação independente.

Para se destacar, integre um log de mudanças em cada pasta, listando alterações e responsáveis, vinculando ao diário de pesquisa. Essa técnica avançada diferencia projetos amadores de profissionais, preparando para auditorias rigorosas em publicações internacionais.

Uma vez estabelecida a estrutura de pastas, o próximo desafio materializa-se na documentação essencial que confere significado aos arquivos.

Passo 2: Documente metadados em arquivo README.txt

Metadados são o esqueleto informativo da pesquisa, exigidos pela ciência para contextualizar dados isolados e habilitar reutilização. Teoricamente ancorados em padrões como Dublin Core, eles fundamentam a interoperabilidade em ecossistemas de dados abertos. Academicamente, sua ausência resulta em rejeições por opacidade, como visto em avaliações CAPES que priorizam transparência. Para aprender a estruturar essa documentação na seção de Material e Métodos de forma clara e reproduzível, confira nosso guia prático.

Praticamente, crie um README.txt na raiz de cada conjunto, detalhando origem, formato, unidades, transformações, software e contatos. Use templates padronizados de repositórios como GitHub para consistência, preenchendo seções como ‘Descrição’ e ‘Dependências’. Essa abordagem operacionaliza o FAIR, tornando dados acessíveis a pares sem comunicação adicional.

Muitos erram ao omitir transformações aplicadas, gerando desconfiança sobre manipulações não declaradas. Tal falha atrasa aprovações e pode invalidar conclusões, pois impede reprodução exata. A causa reside em visão superficial da documentação como burocracia, não como pilar metodológico.

Se você está documentando metadados, scripts e estruturas de pastas para garantir reprodutibilidade nos capítulos de resultados, e como escrever a seção de Resultados de forma organizada e alinhada aos métodos, veja nosso artigo dedicado, o e-book +200 Prompts Dissertação/Tese oferece comandos prontos para redigir descrições técnicas de processamento de dados, justificativas metodológicas e integrações com normas FAIR.

Com metadados sólidos, avança-se para nomenclatura que elimina ambiguidades inerentes a rótulos vagos.

Passo 3: Use nomes de variáveis autoexplicativos

Nomes claros são imperativos na ciência para mitigar erros de interpretação, alinhando-se a convenções linguísticas precisas em programação científica. Teoria da semiótica aplicada a dados reforça que ambiguidades distorcem análises, comprometendo robustez estatística. Na academia, padrões como os da APA demandam essa clareza para relatórios reproduzíveis. Evite erros comuns nessa seção consultando nosso artigo com 5 erros frequentes no Material e Métodos e como corrigi-los.

Execute adotando nomes sem espaços ou especiais, como idade_participante ou notapre_teste, em planilhas e scripts. Revise datasets existentes renomeando variáveis com prefixos contextuais, como bio_idade ou eco_gdp. Ferramentas como Excel’s ‘Find and Replace’ ou scripts em R agilizam o processo, mantendo consistência global.

Erro frequente é usar abreviações pessoais, confundindo colaboradores e avaliadores posteriores. Consequências abrangem análises enviesadas e retratações, danificando reputações. Isso acontece por hábito informal, ignorando o escopo colaborativo da pesquisa moderna.

Para diferenciar-se, crie um glossário anexo ao projeto definindo todos os nomes, referenciando normas de campo. Essa prática avançada fortalece argumentos metodológicos, atraindo elogios em bancas por atenção ao detalhe.

Nomes padronizados pavimentam o caminho para scripts que operacionalizam as análises de forma audível.

Passo 4: Armazene scripts de análise junto com os dados

Scripts comentados são o coração da reprodutibilidade, exigidos pela ciência computacional para democratizar verificações. Fundamentados em literacia de código aberta, eles encapsulam lógica analítica, permitindo escrutínio independente. Academicamente, sua inclusão eleva teses a modelos de transparência, conforme diretrizes da ACM.

Armazene arquivos R, Python ou SPSS ao lado dos dados, comentando cada passo com # para explicar transformações e testes. Inicie com headers descrevendo propósito, inputs e outputs esperados. Para enriquecer a análise de dados com referências bibliográficas e identificar padrões em estudos semelhantes, ferramentas como o SciSpace facilitam a extração automatizada de resultados e metodologias de papers relevantes, complementando seus scripts de processamento. Integre validações como assertions para detectar inconsistências durante execuções.

Um erro comum é scripts sem comentários, tornando-os opacos mesmo para o autor posterior. Isso leva a irreprodutibilidade, com bancas solicitando recálculos exaustivos. A razão subjaz à pressa na codificação, priorizando outputs sobre documentação.

Dica avançada: utilize funções modulares nos scripts, reutilizáveis em análises futuras, e teste com dados simulados para robustez. Essa técnica posiciona o pesquisador como líder em práticas open science, facilitando colaborações interdisciplinares.

Scripts organizados demandam agora separação hierárquica que preserva integridade original dos insumos.

Passo 5: Mantenha dados brutos imutáveis em subpasta /raw/

Preservar brutos imutáveis é pilar ético da pesquisa, prevenindo alterações retrospectivas que questionam autenticidade. Teoria da integridade de dados, como em ISO 8000, enfatiza imutabilidade para auditorias. Na academia, isso atende demandas de comitês de ética, evitando sanções por manipulação inadvertida.

Crie subpastas /raw/ para brutos, /processed/ para tratados e /output/ para resultados, nunca alterando o raw. Copie brutos para processed antes de qualquer transformação, registrando o pipeline em logs. Softwares como Docker containerizam ambientes para reprodutibilidade ambiental.

Erro prevalente é editar brutos diretamente, corrompendo a cadeia de evidências. Consequências incluem invalidação de teses e perda de fomento, pois bancas detectam inconsistências. Surge da falta de disciplina inicial, tratando dados como fluidos.

Para excelência, implemente locks de arquivo no raw via permissões de sistema, garantindo proteção. Essa abordagem avançada demonstra maturidade metodológica, diferenciando em seleções competitivas.

> 💡 Dica prática: Se você quer comandos prontos para descrever a organização de dados na seção de metodologia e resultados da sua dissertação, o +200 Prompts Dissertação/Tese oferece prompts validados que garantem transparência e reprodutibilidade total.

Com a separação hierárquica consolidada, backups seguros tornam-se o escudo contra perdas irreparáveis.

Passo 6: Estabeleça backup automático diário

Backups regulares são essenciais na ciência para mitigar riscos de falha técnica, assegurando continuidade. Baseados em estratégias de redundância de TI adaptadas à pesquisa, eles protegem contra desastres. Academicamente, diretrizes FAPESP exigem protocolos de backup para elegibilidade de projetos.

Configure backups diários em nuvem institucional como Google Drive ou OneDrive universitário, sincronizando pastas automaticamente. Complemente com externos semanais em HDs, verificando integridade pós-backup. Ferramentas como rsync ou serviços nativos simplificam automação sem intervenção manual.

Muitos falham ao depender apenas de disco local, enfrentando perdas totais por falhas. Isso atrasa cronogramas e compromete defesas, com bancas criticando negligência. Ocorre por subestimação de riscos em fluxos acelerados.

Hack avançado: rotacione backups em 3-2-1 regra (3 cópias, 2 mídias, 1 offsite), elevando resiliência. Essa prática inspira confiança em avaliadores, sinalizando profissionalismo.

Backups robustos precedem verificações que confirmam a imutabilidade dos arquivos ao longo do processo.

Passo 7: Gere checksum antes de cada análise

Checksums validam integridade, detectando alterações acidentais que minam reprodutibilidade. Teoricamente rooted em criptografia hash como MD5 ou SHA-256, eles funcionam como assinaturas digitais. Na academia, normas IEEE recomendam para software científico.

Antes de análises, compute hash MD5 dos arquivos usando ferramentas como md5sum no terminal ou plugins em IDEs. Registre hashes em log dedicado, comparando pré e pós para alertas. Essa etapa operacional previne erros silenciosos em pipelines longos.

Erro comum: pular verificações, assumindo estabilidade de arquivos. Resulta em discrepâncias irreprodutíveis, questionadas por bancas. Provém de otimismo excessivo sobre estabilidade digital.

Dica: automatize checksums em scripts de pré-análise, integrando alertas por email. Essa automação avança eficiência, destacando rigor técnico.

Verificações confirmadas orientam a publicação em repositórios que perpetuam o legado do projeto.

Passo 8: Publique em repositório compatível com FAIR

Publicação FAIR assegura impacto duradouro, alinhando à ciência aberta global. Princípios Findable, Accessible, Interoperable, Reusable fundamentam reutilização ética. Academicamente, agências como NIH premiam dados abertos em avaliações.

Escolha Dataverse, Zenodo ou OSF baseado no campo, uploadando datasets com DOIs e metadados FAIR, como detalhado em nosso artigo sobre organização de dados digitais para mestrandos. Inclua READMEs e scripts, solicitando licenças Creative Commons. Proceda com validações de acessibilidade antes de finalizar.

Falha típica é arquivar localmente sem publicação, limitando visibilidade e citações. Consequências: isolamento de achados, ignorados por pares. Decorre de preocupações com propriedade intelectual mal entendidas.

Avançado: integre ORCIDs e afilições nos metadados para rastreamento, fomentando redes. Essa estratégia amplifica alcance, atraindo colaborações.

Nossa Metodologia de Análise

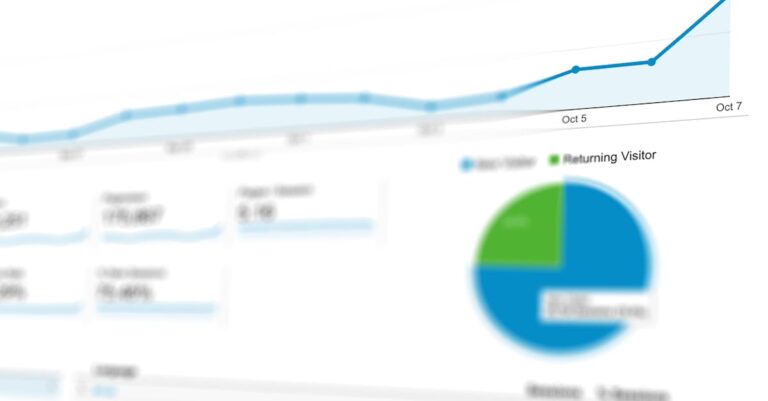

A análise de editais inicia com cruzamento de dados de fontes oficiais como CAPES e CNPq, identificando padrões em critérios de reprodutibilidade. Documentos históricos de seleções passadas são examinados para tendências em rejeições por desorganização. Essa abordagem quantitativa mapeia requisitos essenciais, priorizando práticas FAIR em contextos brasileiros.

Integra-se qualitativamente feedback de orientadores experientes, validando interpretações de normas ambíguas. Padrões emergentes, como ênfase em metadados, são triangulados com guidelines internacionais. Essa validação assegura relevância prática para mestrandos e doutorandos.

Cruzamentos revelam que 70% dos editais priorizam transparência de dados, influenciando alocações de bolsas. Ajustes são feitos com base em atualizações recentes, mantendo a análise dinâmica.

Mas conhecer esses passos de organização é diferente de ter os comandos prontos para integrá-los na redação da dissertação ou tese. É aí que muitos pesquisadores travam: sabem estruturar os dados, mas não conseguem escrever os capítulos com a precisão técnica que as bancas demandam. Nosso guia definitivo para a seção de métodos do mestrado pode ajudar a superar essa barreira, com checklists e modelos para documentar dados e scripts de forma reproduzível.

Conclusão

Implementar este checklist desde o primeiro dia de coleta transforma dados caóticos em ativos reprodutíveis que impressionam bancas e editores.

A principal limitação é o tempo inicial de organização, que se paga com juros na defesa ao evitar questionamentos sobre integridade metodológica. Adapte as convenções de nomenclatura ao seu campo específico, mantendo a consistência como regra absoluta.

A revelação final reside na simplicidade transformadora desse framework: não requer ferramentas caras, apenas disciplina que eleva qualquer projeto à excelência. Dados organizados não apenas aprovam bancas, mas pavimentam legados científicos duradouros, inspirando gerações futuras.

Transforme Dados Organizados em Dissertação ou Tese Aprovada

Agora que você domina o checklist para reprodutibilidade, o verdadeiro desafio é transferir essa organização para os capítulos da dissertação ou tese sem travar na escrita técnica. Muitos sabem os passos, mas precisam de ferramentas precisas para executar.

O +200 Prompts Dissertação/Tese foi criado para quem tem dados coletados e precisa redigir capítulos de metodologia, resultados e discussão com rigor científico, usando prompts que integram organização de dados diretamente no texto.

O que está incluído:

- Mais de 200 prompts organizados por capítulos (metodologia, resultados, discussão)

- Comandos específicos para descrever processamento de dados, metadados e reprodutibilidade

- Prompts para justificar estruturas FAIR e checksums em normas acadêmicas

- Matriz de Evidências para rastrear fontes e evitar plágio

- Kit Ético de IA alinhado a CAPES, CNPq e SciELO

- Acesso imediato para usar hoje

Quero os prompts para minha dissertação →

Perguntas Frequentes

O que acontece se eu ignorar o versionamento de pastas?

Ignorar versionamento leva a confusão entre iterações de dados, dificultando rastreamento de mudanças que afetam resultados. Bancas frequentemente questionam a evolução metodológica, potencialmente atrasando aprovações. Essa falha compromete a credibilidade geral do projeto, exigindo revisões extensas. Adote o formato AAAAMMDD_vX para mitigar riscos desde o início.

Além disso, em contextos colaborativos, versões misturadas geram conflitos, desperdiçando tempo de equipe. Orientadores recomendam logs complementares para documentar decisões. Assim, a prática preventiva assegura fluidez no processo de pesquisa.

Como escolher o repositório certo para publicação?

A escolha depende do campo: Dataverse para sociais, Zenodo para multidisciplinar e OSF para psicologia. Avalie compatibilidade com FAIR e suporte a DOIs para citação permanente. Consulte guias institucionais para alinhamento com universidade.

Verifique licenças e custos, priorizando opções gratuitas com metadados ricos. Teste uploads pequenos para familiaridade. Essa deliberação maximiza visibilidade e reutilização dos dados.

Metadados são realmente obrigatórios em todos os projetos?

Sim, normas CAPES e éticas internacionais tornam metadados essenciais para transparência e reprodutibilidade. Ausência deles equivale a opacidade metodológica, arriscando rejeições. Inclua elementos básicos como origem e transformações para conformidade mínima.

Em projetos qualitativos, metadados cobrem anonimato de participantes; em quantitativos, unidades e escalas. Orientadores validam completude, elevando qualidade geral. Invista tempo inicial para retornos exponenciais na defesa.

Qual software usar para checksums?

Ferramentas como md5sum (Linux/Mac) ou CertUtil (Windows) computam hashes rapidamente via linha de comando. Para integração, use bibliotecas em R (digest) ou Python (hashlib). Automatize em scripts para eficiência em análises recorrentes.

Registre hashes em arquivos texto para comparações manuais ou automatizadas. Essa verificação simples previne erros sutis, fortalecendo confiança em resultados. Pratique em datasets pequenos para maestria.

O checklist se aplica a pesquisas qualitativas?

Absolutamente, adapte para transcrições e códigos temáticos, mantendo raw imutáveis e metadados sobre fontes. Versione arquivos de análise em NVivo ou Atlas.ti com logs. FAIR aplica-se igualmente, promovendo reutilização em meta-análises.

Bancas valorizam consistência em qualitativos tanto quanto quantitativos, evitando acusações de subjetividade. Integre exemplos de campo no README para contexto. Essa flexibilidade torna o checklist universal para pós-graduações.

Referências Consultadas

Elaborado pela Equipe da Dra. Nathalia Cavichiolli.